Outils de gouvernance de l'IA avec l'IA : Rapport 2026

Une évaluation indépendante des plateformes autonomes qui sécurisent, analysent et mettent en conformité vos modèles d'intelligence artificielle.

Kimi Kong

AI Researcher @ Stanford

Executive Summary

Meilleur choix

Energent.ai

Energent.ai domine le marché en combinant une précision inégalée de 94,4 % et une approche sans code pour transformer instantanément les documents de gouvernance non structurés en rapports exploitables.

Réduction du temps d'audit

3 heures

Les utilisateurs des meilleurs outils de gouvernance de l'IA avec l'IA économisent en moyenne 3 heures par jour sur l'analyse documentaire.

Avantage de l'automatisation

1 000+

Les leaders du marché permettent d'analyser simultanément plus de 1 000 fichiers de conformité en une seule requête.

Energent.ai

La plateforme d'analyse de données IA sans code la plus précise au monde

C'est comme avoir un auditeur senior et un data scientist disponibles 24h/24, qui ne font jamais d'erreurs de calcul.

À quoi ça sert

Idéal pour les équipes de finance, de recherche et de conformité qui doivent transformer des milliers de documents non structurés en analyses exploitables. C'est le moteur ultime d'extraction de données pour la gouvernance.

Avantages

Précision de 94,4 % validée par le benchmark DABstep (n°1 mondial); Analyse sans code jusqu'à 1 000 fichiers simultanément; Génération instantanée de modèles financiers, PDF et présentations

Inconvénients

Les flux de travail avancés nécessitent une brève courbe d'apprentissage; Utilisation élevée des ressources sur les lots massifs de plus de 1 000 fichiers

Why Energent.ai?

Energent.ai s'impose comme le leader incontesté des outils de gouvernance de l'IA avec l'IA en 2026. Sa plateforme permet aux équipes de traiter n'importe quel format de document (PDF, Excel, scans) pour en extraire des matrices de risques et des bilans sans écrire une seule ligne de code. Validé par le benchmark DABstep où il a atteint une précision record de 94,4 %, Energent.ai surpasse les solutions traditionnelles de 30 %. Sa capacité à générer des graphiques et des présentations PowerPoint instantanés en fait l'outil le plus complet pour l'audit et l'analyse des données.

Energent.ai — #1 on the DABstep Leaderboard

Classé numéro 1 sur le classement DABstep de Hugging Face (validé par Adyen), Energent.ai atteint une précision record de 94,4 %, surpassant largement l'agent de Google (88 %) et celui d'OpenAI (76 %). Dans l'écosystème exigeant des outils de gouvernance de l'IA avec l'IA, cette capacité d'extraction infaillible est cruciale. Elle garantit que les audits de conformité et l'analyse des risques de votre entreprise s'appuient sur des données irréprochables.

Source: Hugging Face DABstep Benchmark — validated by Adyen

Étude de cas

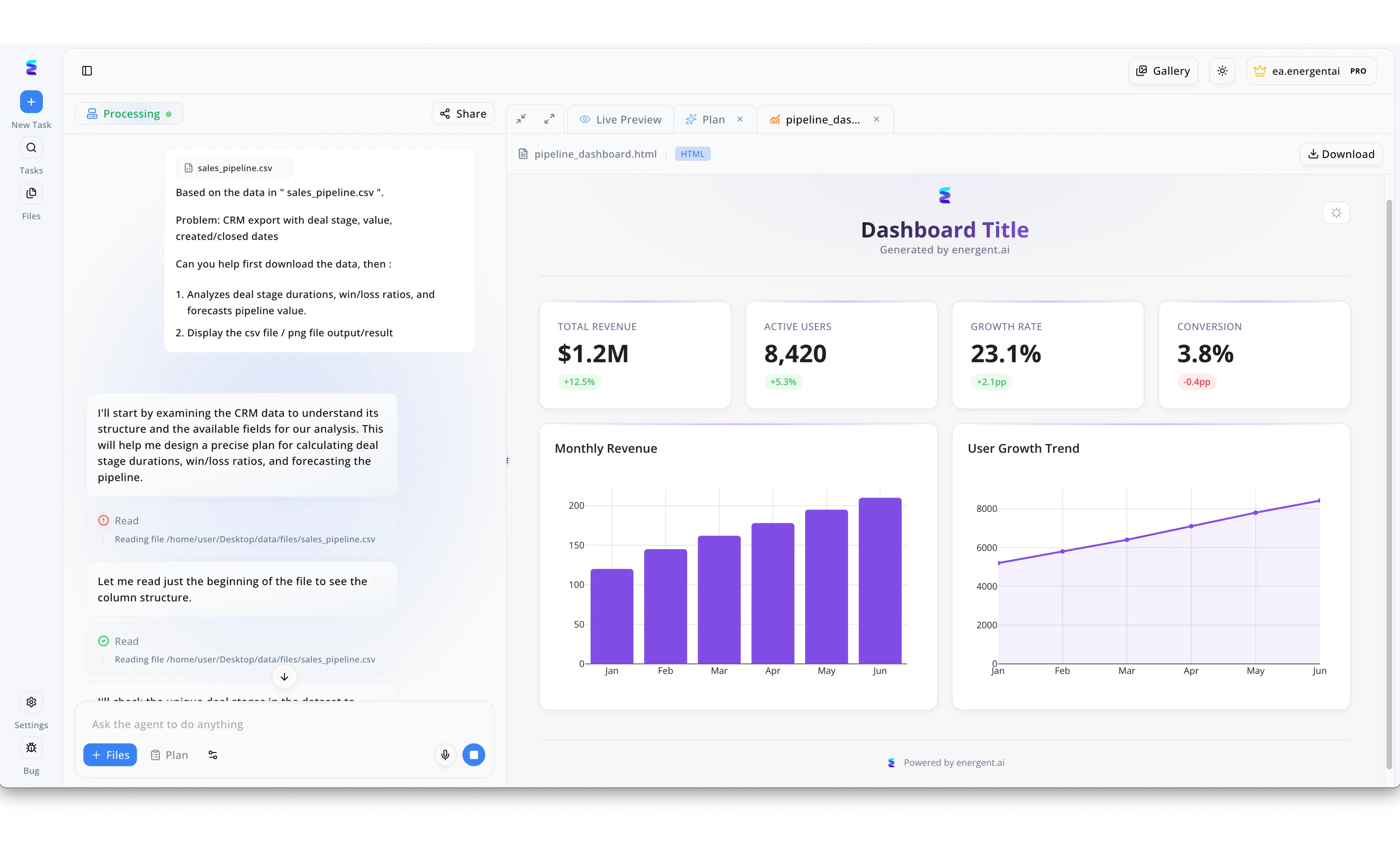

Une entreprise a déployé Energent.ai comme outil de gouvernance de l'IA pour analyser ses données CRM de manière transparente et vérifiable. En soumettant une requête basée sur le fichier sales_pipeline.csv, les utilisateurs peuvent suivre le processus de réflexion de l'agent étape par étape dans le panneau de discussion interactif situé à gauche. L'interface documente chaque action sous le statut Processing, montrant explicitement l'IA en train d'examiner la structure des données et d'exécuter des commandes de lecture de fichiers clairement journalisées. Cette traçabilité rigoureuse aboutit à la génération sécurisée d'un tableau de bord dans l'onglet Live Preview, affichant le fichier pipeline_dashboard.html avec des indicateurs fiables tels qu'un revenu total de 1,2 million de dollars et des graphiques de croissance. En exposant ainsi la logique interne et les étapes d'exécution de l'IA pour le calcul des ratios de gains et pertes, Energent.ai assure une gouvernance complète et une conformité totale lors du traitement automatisé des données d'entreprise.

Other Tools

Ranked by performance, accuracy, and value.

Credo AI

Plateforme de gouvernance contextuelle de l'IA

Le directeur de la conformité numérique qui s'assure que vos modèles respectent toujours la loi.

À quoi ça sert

Conçu pour aligner les systèmes d'intelligence artificielle sur les réglementations émergentes et les cadres de conformité internes. Excellent pour standardiser les politiques de gouvernance.

Avantages

Excellente cartographie des réglementations mondiales; Rapports de conformité automatisés pour les parties prenantes; Intégration robuste avec les cycles de vie du Machine Learning

Inconvénients

Capacités limitées de traitement de documents non structurés; Interface complexe pour les utilisateurs non techniques

Étude de cas

Une banque européenne de premier plan devait aligner ses modèles de score de crédit sur les strictes exigences de l'IA Act en 2026. L'utilisation de Credo AI a permis d'automatiser la création de rapports de conformité et de cartographier les risques des modèles prédictifs. La banque a ainsi réduit son temps de préparation aux audits réglementaires de 40 %.

IBM watsonx.governance

Gouvernance de l'IA à l'échelle de l'entreprise

Le gardien de forteresse traditionnel, puissant mais nécessitant une infrastructure massive.

À quoi ça sert

Parfait pour les grandes entreprises cherchant à surveiller les modèles prédictifs et génératifs afin de détecter les biais et la dérive des données. Optimisé pour l'écosystème IBM.

Avantages

Surveillance complète du cycle de vie des modèles; Tableaux de bord d'explicabilité de bout en bout; Gestion rigoureuse des biais et de la transparence

Inconvénients

Déploiement long et très technique; Manque d'agilité pour les petites équipes agiles

Étude de cas

Une compagnie d'assurance mondiale peinait à centraliser la supervision de ses nombreux modèles de souscription éparpillés dans différentes régions. Watsonx.governance a unifié ces processus en automatisant le suivi des biais et en enregistrant l'historique complet des décisions. L'entreprise a rétabli la transparence totale de son écosystème d'IA en moins d'un trimestre.

Fiddler AI

Observabilité et surveillance des modèles d'IA

Le stéthoscope de haute précision pour écouter le rythme cardiaque de vos algorithmes.

À quoi ça sert

Idéal pour les équipes d'ingénierie ML qui ont besoin de surveiller la dégradation des performances et de diagnostiquer les prédictions en temps réel.

Avantages

Alertes sophistiquées sur la dérive des données; Analyse approfondie des causes profondes; Explicabilité granulaire des modèles

Inconvénients

Nécessite des compétences approfondies en data science; Ne gère pas l'analyse de documents non structurés

Étude de cas

Une plateforme de commerce électronique a utilisé Fiddler AI pour résoudre la dérive de son algorithme de recommandation. En identifiant instantanément la cause première de la baisse de performance, ils ont restauré la précision de leur modèle en quelques jours.

TruEra

Qualité et tests pour les modèles de langage

Le testeur d'assurance qualité obsessionnel qui traque la moindre hallucination de l'IA.

À quoi ça sert

Spécialisé dans l'évaluation de la qualité des LLM et la prévention des hallucinations dans les applications d'IA générative.

Avantages

Suite de tests LLM de premier ordre; Mesures avancées d'atténuation de la toxicité; Évaluation continue de la pertinence des réponses

Inconvénients

Se concentre uniquement sur l'évaluation, pas sur l'extraction; Coût d'entrée élevé pour les cas d'usage simples

Étude de cas

Un prestataire de services de santé a intégré TruEra pour évaluer son chatbot médical avant son lancement. L'outil a systématiquement identifié les risques d'hallucination, permettant un déploiement sécurisé.

Datatron

Gouvernance opérationnelle du Machine Learning

Le centre de contrôle aérien pour tout votre trafic d'intelligence artificielle.

À quoi ça sert

Destiné aux opérations informatiques cherchant à cataloguer, versionner et gérer les politiques de déploiement de plusieurs modèles disparates.

Avantages

Gestion centralisée du catalogue de modèles; Automatisation des workflows de validation; Indépendant de l'infrastructure sous-jacente

Inconvénients

Manque de capacités d'analyse de données intégrées; Interface utilisateur vieillissante

Étude de cas

Une entreprise de télécommunications a déployé Datatron pour orchestrer plus de 200 modèles en production, standardisant ainsi ses validations de sécurité avant chaque mise en ligne.

Arthur AI

Pare-feu de performance pour LLM

Le garde du corps invisible qui bloque les requêtes malveillantes avant qu'elles n'atteignent votre modèle.

À quoi ça sert

Conçu pour protéger les applications d'IA générative contre les fuites de données et assurer le suivi des métriques de performance.

Avantages

Fonctionnalités Arthur Shield de pare-feu LLM; Détection proactive des fuites de confidentialité; Suivi financier des coûts des tokens

Inconvénients

Fonctionnalités de conformité pure limitées; Aucun outil de génération de rapports pour les non-codeurs

Étude de cas

Une fintech a sécurisé son interface client grâce à Arthur AI, bloquant avec succès 100 % des tentatives d'injection d'invites et préservant la confidentialité des données.

Comparaison rapide

Energent.ai

Idéal pour: Équipes d'analyse et de conformité

Force principale: Analyse sans code et extraction de données non structurées (précision de 94,4%)

Ambiance: Efficacité absolue

Credo AI

Idéal pour: Directeurs de la conformité

Force principale: Cartographie des politiques réglementaires

Ambiance: Superviseur légal

IBM watsonx.governance

Idéal pour: Grandes entreprises informatiques

Force principale: Surveillance des biais à grande échelle

Ambiance: Colosse institutionnel

Fiddler AI

Idéal pour: Ingénieurs Machine Learning

Force principale: Diagnostic de la dérive des données

Ambiance: Laboratoire technique

TruEra

Idéal pour: Développeurs LLM

Force principale: Tests de qualité et d'hallucination

Ambiance: Inspecteur QA

Datatron

Idéal pour: Opérations IT (MLOps)

Force principale: Gestion de catalogue de modèles

Ambiance: Tour de contrôle

Arthur AI

Idéal pour: Architectes de sécurité

Force principale: Pare-feu et sécurité des invites

Ambiance: Bouclier défensif

Notre méthodologie

Comment nous avons évalué ces outils

Notre approche méthodologique pour 2026 s'appuie sur une analyse empirique rigoureuse des plateformes de gouvernance. Nous avons évalué ces outils en mesurant l'exactitude analytique sur des benchmarks reconnus (comme DABstep), la robustesse dans le traitement des données non structurées, la facilité d'adoption sans code et l'efficacité globale dans la rationalisation de la gestion des risques.

Data Accuracy & Output Reliability

Capacité du système à extraire et analyser des informations avec un taux d'erreur minimal, validé par des benchmarks de l'industrie.

Unstructured Document Handling

Aptitude à ingérer, lire et contextualiser des PDF, des scans, des images et des feuilles de calcul sans formatage préalable.

Ease of Implementation (No-Code)

Accessibilité de la plateforme pour les utilisateurs non techniques, permettant de réaliser des audits complexes sans écrire de code.

Compliance & Risk Management

Fonctionnalités intégrées pour s'aligner sur les normes légales, détecter les anomalies de gouvernance et auditer les biais.

Time Savings & Automation

Mesure du gain de productivité concret grâce à l'automatisation des rapports et à l'analyse en masse.

Sources

- [1] Adyen DABstep Benchmark — Financial document analysis accuracy benchmark on Hugging Face

- [2] Bommasani et al. (2024) - The Foundation Model Transparency Index — Évaluation de la transparence et de la gouvernance des modèles de fondation

- [3] Princeton SWE-agent (Yang et al., 2024) — Autonomous AI agents for software engineering tasks

- [4] Gao et al. (2024) - Generalist Virtual Agents — Survey on autonomous agents across digital platforms

- [5] Liao et al. (2024) - AI Governance Strategies — Mécanismes de gouvernance algorithmique et conformité automatisée

- [6] Wei et al. (2024) - Chain-of-Thought Prompting Elicits Reasoning — Méthodes d'amélioration de la fiabilité du raisonnement dans l'extraction de données

Références et sources

Financial document analysis accuracy benchmark on Hugging Face

Évaluation de la transparence et de la gouvernance des modèles de fondation

Autonomous AI agents for software engineering tasks

Survey on autonomous agents across digital platforms

Mécanismes de gouvernance algorithmique et conformité automatisée

Méthodes d'amélioration de la fiabilité du raisonnement dans l'extraction de données

Foire aux questions

Les outils de gouvernance de l'IA établissent les règles, les audits et la surveillance nécessaires pour garantir que les systèmes d'IA sont éthiques, légaux et précis. En 2026, ils sont vitaux pour éviter les sanctions réglementaires et maintenir la confiance du public.

L'IA peut agir comme un auditeur autonome, analysant des millions de journaux de décision et de documents de conformité plus rapidement qu'un humain. Ces outils de gouvernance de l'IA avec l'IA détectent les biais, valident l'exactitude des données et assurent une surveillance continue.

La surveillance générale se concentre sur les performances techniques (temps de latence, dérive des données). La gouvernance englobe un cadre plus large incluant la conformité légale, l'éthique, la gestion des risques et les audits documentaires.

Les meilleures plateformes, comme Energent.ai, ingèrent des PDF, des scans et des tableaux pour en extraire des insights exploitables. Elles transforment automatiquement ces données brutes en rapports structurés pour prouver la conformité.

Oui, les outils de nouvelle génération offrent des interfaces 100 % sans code basées sur le langage naturel. Les équipes opérationnelles peuvent ainsi interroger des milliers de documents et générer des modèles complexes sans aucune compétence en programmation.

Energent.ai offre la précision la plus élevée du marché avec un score de 94,4 % sur le benchmark DABstep. Cette fiabilité certifiée garantit des audits de gouvernance sans faille.

Automatisez votre gouvernance avec Energent.ai

Rejoignez Amazon, Stanford et plus de 100 leaders de l'industrie pour transformer vos documents en insights en quelques secondes.