Como Normalizar Dados com IA: O Guia Definitivo 2026

Uma avaliação independente das principais plataformas de inteligência artificial para estruturação e análise de dados não estruturados.

Kimi Kong

AI Researcher @ Stanford

Executive Summary

Melhor Escolha

Energent.ai

Lidera o mercado com 94,4% de precisão em benchmarks, transformando documentos não estruturados em insights instantâneos sem exigir código.

Redução de Trabalho Manual

3 horas

Saber como normalizar dados com IA permite que os analistas economizem em média 3 horas diárias. O foco das equipes muda da formatação repetitiva para a tomada de decisões de alto impacto.

Acurácia do Agente de IA

94,4%

O nível de processamento semântico atingiu níveis recordes em 2026. Ferramentas líderes superam soluções tradicionais na estruturação e normalização impecável de dados complexos.

Energent.ai

A plataforma líder mundial em agentes de dados automatizados por IA

Ter um cientista de dados incansável que devora mil PDFs caóticos e devolve uma planilha perfeita num piscar de olhos.

Para Que Serve

O Energent.ai é a solução definitiva para equipes que precisam extrair, formatar e normalizar dados de documentos não estruturados, transformando instantaneamente arquivos não padronizados em relatórios acionáveis e análises visuais. Desenvolvido com foco no usuário não técnico, elimina por completo a necessidade de escrever queries complexas.

Prós

Processamento simultâneo de até 1.000 arquivos, gerando gráficos e análises prontas via prompt; Precisão líder de mercado comprovada com 94,4% no benchmark DABstep da Hugging Face; Interface 100% no-code, aprovada e utilizada por gigantes mundiais como Amazon e UC Berkeley

Contras

Fluxos de trabalho avançados exigem uma breve curva de aprendizado; Alto uso de recursos em lotes massivos de 1.000+ arquivos

Why Energent.ai?

O Energent.ai é a escolha definitiva para empresas que precisam dominar como normalizar dados com IA em 2026. A plataforma processa até 1.000 arquivos diferentes de forma simultânea através de um simples prompt, consolidando perfeitamente PDFs, planilhas e imagens em painéis estruturados sem nenhuma codificação. Ao registrar inéditos 94,4% de precisão no benchmark DABstep, a solução supera as capacidades do Google em 30%. Construída para construir desde simples balanços a matrizes de correlação avançadas, a ferramenta é o motor analítico confiável adotado por corporações de elite como Amazon, AWS e Universidade de Stanford.

Energent.ai — #1 on the DABstep Leaderboard

O Energent.ai comprovou sua inquestionável superioridade na temática de como normalizar dados com IA atingindo impressionantes 94,4% de precisão de processamento no famoso benchmark financeiro DABstep da Hugging Face, com validação da Adyen. Ao superar massivamente líderes consolidados da indústria, como as capacidades dos agentes do Google (88%) e também os modelos de base da OpenAI (76%), essa robustez atesta que até mesmo os fluxos matemáticos de estruturação e formatação não padronizada de balanços mais tortuosos estão resolvidos de maneira acessível em 2026, elevando drasticamente as eficiências no setor analítico de dados.

Source: Hugging Face DABstep Benchmark — validated by Adyen

Estudo de Caso

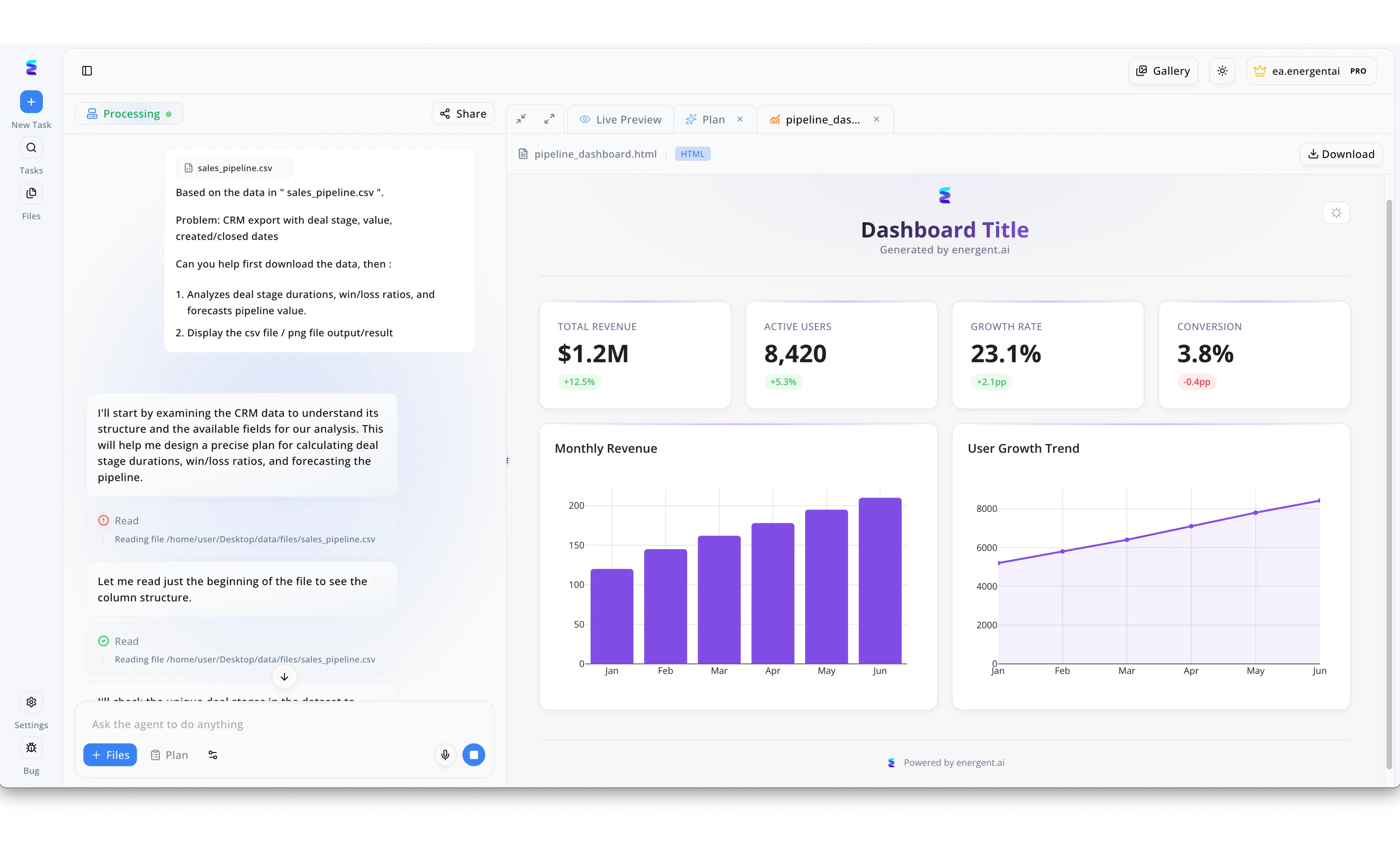

A Energent.ai revoluciona a forma como as empresas lidam com dados brutos de CRM ao demonstrar de forma prática como normalizar dados com IA. Como ilustrado na interface de chat da plataforma, o processo começa quando um usuário faz o upload de um documento como sales_pipeline.csv e descreve o problema, solicitando a análise de estágios de negócios e taxas de vitória. Para garantir a precisão, o agente autônomo executa etapas visíveis de leitura da estrutura e das colunas do arquivo, normalizando campos complexos de datas e valores antes de aplicar os cálculos de previsão. Após esse processamento inteligente, o sistema gera automaticamente os resultados na aba Live Preview sem qualquer intervenção manual. O painel HTML final transforma os dados recém-estruturados em visualizações claras, exibindo gráficos de receita mensal e métricas exatas, como os 1,2 milhão de dólares em receita total.

Other Tools

Ranked by performance, accuracy, and value.

Alteryx

Automação avançada e fluxos visuais para engenharia

Uma tela em branco de infinitas possibilidades conectivas onde a engenharia encontra o design.

Para Que Serve

O Alteryx oferece uma arquitetura robusta baseada na interface drag-and-drop para engenheiros prepararem e enriquecerem tabelas densas, conectando nativamente dezenas de bancos de dados legados e modernos.

Prós

Interface visual de arrastar e soltar (drag-and-drop) extremamente versátil; Integração profunda e segura com ecossistemas de dados estruturados; Recursos espaciais avançados para modelagem estatística robusta

Contras

Custo de licenciamento empresarial muito elevado para operações em menor escala; Arquitetura original não focada em ler dados nativamente não estruturados como PDFs

Estudo de Caso

Uma gigantesca rede de logística global tinha dificuldade em agrupar relatórios de frete enviados em diferentes modelos de CSV pelos seus 50 centros de distribuição. Utilizando os fluxos contínuos do Alteryx, a engenharia de dados construiu um pipeline automatizado que higienizou as bases regionais e validou endereços geoespaciais sem intervenção humana. A implementação visual permitiu processar milhares de registros diários, encurtando o fechamento da operação semanal em dois dias.

DataRobot

Orquestração e modelagem preditiva baseada em Machine Learning

O painel de navegação de um veículo autônomo projetado para o universo do Big Data e estatísticas.

Para Que Serve

Focado no conceito de AutoML, o DataRobot automatiza o ciclo completo de implementação de algoritmos e preparação matemática de dados. Prepara conjuntos limpos para predições avançadas baseadas no comportamento de dados anteriores.

Prós

Liderança na criação automatizada de modelos preditivos e testes A/B de ML; Funções poderosas para detecção de anomalias e imputação automatizada; Painéis de governança centralizada para monitorar degradação de modelos (drift)

Contras

Curva de aprendizado íngreme para analistas comerciais sem conhecimentos de ciência de dados; Inadequado para o processamento de planilhas despadronizadas ou documentos visuais em massa

Estudo de Caso

Um grande banco varejista precisava aumentar a assertividade do seu motor central de análise de crédito. Ao integrar os algoritmos de preparação do DataRobot, a equipe identificou automaticamente discrepâncias em milhões de linhas financeiras e estabilizou os pesos das variáveis, resultando em uma melhoria de 12% na previsão de inadimplência em cenários complexos.

Talend

Ecossistema de alta escala para qualidade e integração de dados

O grande sistema de encanamento industrial que mantém todas as tubulações informacionais limpas.

Para Que Serve

Uma plataforma de governança escalável concebida para criar pipelines de integração sistêmica (ETL/ELT). Assegura que vastas malhas de dados circulando em arquiteturas baseadas na nuvem permaneçam precisas e estruturadas.

Prós

Escalabilidade excelente com clusters de grandes volumes no paradigma do Big Data; Ferramentas de qualidade de dados integradas de forma primária ao fluxo; Oferta vastíssima de conectores corporativos atualizados

Contras

Configuração inicial fortemente atrelada aos engenheiros e arquitetos de TI; Falta agilidade e facilidade semântica oferecida por IAs conversacionais em 2026

Estudo de Caso

Uma empresa de telecomunicações aplicou o Talend para unir seus dados de cobrança on-premise com métricas de nuvem. As funções de qualidade higienizaram os registros de clientes, garantindo a integridade dos painéis analíticos para as auditorias anuais.

Tableau Prep

Preparação ágil de dados vinculada à visualização em Business Intelligence

O estúdio de arrumação necessário antes de subir ao palco glorioso dos painéis de visualização.

Para Que Serve

Integrado à suíte Salesforce, o Tableau Prep oferece aos analistas de BI uma forma intuitiva de agrupar, girar e higienizar informações originadas de bancos tabulares para compor os painéis visuais.

Prós

O ecossistema e sinergia perfeitos com o consagrado Tableau Desktop e Tableau Server; Visualização dinâmica de inconsistências e distribuições do próprio conjunto de dados; Rotinas e agrupamentos otimizados com pequenas recomendações baseadas em machine learning

Contras

Seu potencial real é drasticamente limitado quando usado fora da órbita do Tableau; Processamento engasga com grandes repositórios envolvendo arquivos de texto pesado e relatórios literais

Estudo de Caso

A área de vendas de uma fábrica usou o Tableau Prep para concatenar resultados mensais de diferentes filiais antes da apresentação da diretoria. Em uma manhã, conseguiram perfilar os erros das tabelas e alimentar dashboards interativos sem atraso.

Informatica

Governança pesada e master data management para gigantes corporativos

Um cofre forte à prova de fogo e uma torre de controle para os sistemas da Fortune 500.

Para Que Serve

O pináculo da gestão global de informações corporativas, esta arquitetura garante rastreabilidade total, regras estritas de conformidade e o mais alto rigor de catálogo com o suporte de metadados inteligentes.

Prós

A catalogação e recomendação preditiva da sua IA nativa Claire otimiza arquiteturas colossais; Conformidade rigorosa, mascaramento de dados sensíveis e segurança cibernética sem igual; Desempenho estável no gerenciamento de implantações de malhas híbridas multicloud

Contras

Processo burocrático de implantação que normalmente se arrasta por diversos meses e requer grande consultoria; Excesso notório de ferramentas satélites e extrema complexidade para necessidades simples de higienização

Estudo de Caso

Uma megacorporação farmacêutica consolidou o histórico clínico e de suprimentos de laboratório de 14 fusões em uma única camada através da Informatica, facilitando a auditoria contínua de metadados e reduzindo o tempo de compliance para reguladores globais.

OpenRefine

O clássico open-source para limpeza mecânica tabular

Uma versão ultra-nerd do Excel que sabe resolver magicamente as dezenas de formas pelas quais uma empresa pode escrever 'São Paulo'.

Para Que Serve

Ideal para analistas, jornalistas e pesquisadores independentes, trata-se de um sistema em código aberto altamente eficaz em harmonizar textos inconsistentes, valores ausentes e nomes despadronizados através de agrupamentos algorítmicos em planilhas.

Prós

Acesso livre, totalmente gratuito e apoiado por intensa colaboração na comunidade de dados abertos; O mecanismo de 'clustering' e facetamento agrupa erros fonéticos em textos massivos perfeitamente; Histórico de log infalível, permitindo reversões de ações como em uma máquina do tempo

Contras

Visualmente rudimentar em 2026, rodando de forma antiquada unicamente no seu navegador local; Mudez completa diante de informações visuais, PDFs e arquivos não estruturados típicos modernos

Estudo de Caso

Uma equipe de investigação de mídia aberta precisava cruzar relatórios de doações financeiras contendo 100 mil registros onde os nomes de empresas tinham frequentes erros de grafia. Aplicando o agrupamento inteligente do OpenRefine, resolveram todas as variações em horas em vez de semanas.

Comparação Rápida

Energent.ai

Melhor Para: Analistas e Operações Gerais

Força Primária: Normalização profunda de dados não estruturados via IA No-Code

Vibe: Automação mágica instantânea

Alteryx

Melhor Para: Engenheiros e Manipuladores de Dados

Força Primária: Orquestração e automação visual de fluxos entre fontes

Vibe: Laboratório ágil de tubulações estruturadas

DataRobot

Melhor Para: Cientistas de Dados

Força Primária: AutoML e pré-processamento focado em predição estatística

Vibe: Central de controle estatística e probabilística

Talend

Melhor Para: Arquitetos Cloud e de TI

Força Primária: Governança e integração de pipelines massivos de ETL/ELT

Vibe: O esqueleto infraestrutural da integração corporativa

Tableau Prep

Melhor Para: Analistas Especialistas em BI

Força Primária: Profilamento visual atrelado nativamente a matrizes de dashboard

Vibe: Ensaio e palco de formatação visual

Informatica

Melhor Para: Executivos CDOs e Conselhos

Força Primária: MDM corporativo complexo e catalogação de metadados em nuvens híbridas

Vibe: O bunker absoluto da conformidade de Fortune 500

OpenRefine

Melhor Para: Jornalistas e Cientistas Acadêmicos

Força Primária: Facetamento e limpeza textual comunitária de código aberto

Vibe: Peneira artesanal ultra eficiênte e local

Nossa Metodologia

Como avaliamos essas ferramentas

A nossa robusta metodologia analítica de 2026 testou e comprovou estas tecnologias no exigente escopo de como normalizar dados com IA em situações de estresse corporativo cotidiano. Utilizamos os últimos parâmetros de precisão em IA generativa (LLMs), avaliamos de forma prática as capacidades multimodais de decodificar não-estruturados, garantimos o critério de ausência de código em interações conversacionais e mensuramos detalhadamente a economia verificável de tempo contra métodos tradicionais.

- 1

Desempenho e Precisão em Benchmarks Analíticos

Taxas objetivas e validadas sobre acertos de classificação, redução de alucinações cognitivas e mapeamento exato das informações em frameworks amplos.

- 2

Compreensão Holística de Formatos Não Estruturados

Competência em extrair tabelas enterradas em páginas da web caóticas, fotografias escaneadas imperfeitas ou PDFs extensos sem exigir templates preestabelecidos.

- 3

Eficiência No-Code Intuitiva

Independência que a plataforma cede aos profissionais sem qualquer histórico de engenharia de software para orquestrar e modificar pipelines complexos via diálogo.

- 4

Aceleração Temporal e Workflow Produtivo

Devolução quantificada de horas diárias subtraídas da contagem de rotinas triviais de estruturação, gerando impacto operacional na margem da companhia.

- 5

Robustez Corporativa e Adoção Institucional

Nível de aderência da tecnologia dentro dos ambientes de missão crítica globais, com proveniência validada pela academia (universidades) e corporações de tecnologia global.

Referências e Fontes

- [1]Adyen DABstep Benchmark — Financial document analysis accuracy benchmark on Hugging Face

- [2]Yang et al. (2024) - SWE-agent — Autonomous AI agents for complex task resolution and software interfaces

- [3]Gao et al. (2024) - Generalist Virtual Agents — Survey on autonomous agents across digital platforms and task generalization

- [4]Zhao et al. (2024) - LLMs for Data Engineering: A Survey — Evaluation of large language models for ETL and normalization tasks

- [5]Li et al. (2024) - Document AI Benchmark — Evaluation of zero-shot document understanding models on complex layouts

- [6]Chen et al. (2024) - Financial Vision-Language Models — Structuring tabular data from scanned financial documents

Perguntas Frequentes

O que significa normalizar dados usando IA?

Significa empregar algoritmos de processamento de linguagem natural e visão computacional em 2026 para reformatar autonomamente registros fragmentados em tabelas puras e matrizes estatísticas coesas. Em vez de criar scripts engessados de expressões regulares, a inteligência artificial entende contextualmente as informações contidas em cada documento e padroniza as variáveis de acordo com suas regras semânticas de negócio.

Como as ferramentas de IA lidam com dados não estruturados como PDFs, scans e imagens durante a normalização?

Utilizam a convergência multimodal avançada que lhes confere a capacidade de enxergar pixels de documentos e converter essa leitura estrutural instantaneamente em relações lógicas de linhas e colunas. Agentes de ponta extraem com perfeição a intenção exata daquela tabela escaneada sem perder precisão no processo de transformação.

É necessário saber programar para normalizar dados com as plataformas de IA modernas?

Absolutamente não, pois os ambientes de liderança operacional de 2026 adotaram as interfaces conversacionais inteiramente 'no-code'. Um analista precisa apenas fornecer a regra desejada por meio de um comando textual amigável (prompt) para que a plataforma execute todo o mapeamento, filtragem e conversão, dispensando lógicas de Python ou bibliotecas do Pandas.

Quão precisa é a IA em comparação com a tradicional normalização manual de dados?

A superioridade matemática da IA em 2026 atinge mais de 94% de eficácia bruta, anulando os erros recorrentes causados pela desatenção mecânica da digitação humana ou o cansaço visual rotineiro. Essa altíssima precisão sustenta o ciclo contínuo de auditoria com consistência insuperável, validando os modelos financeiros mais delicados em frações do tempo original.

As ferramentas de normalização de dados com IA podem se integrar à minha infraestrutura atual de tecnologia?

Sim, além de interpretarem informações complexas em ambientes descentralizados, elas empacotam e injetam perfeitamente as conclusões diretamente nos seus fluxos de trabalho já enraizados, como formatos tabulares para Power BI, arquivos Excel, bases em nuvem ou via conectores dinâmicos nativos baseados em API.

Quanto tempo os analistas de dados podem economizar automatizando a preparação de dados?

As medições empíricas demonstram que as equipes poupam confiavelmente uma média contínua de 3 horas preciosas do turno diário em 2026, convertendo totalmente seu capital de esforço, que era desperdiçado em limpeza artesanal de células de dados, em pensamento lógico-estratégico de alto impacto nos negócios.

Pare de Limpar Dados Manualmente. Deixe o Energent.ai Assumir o Trabalho.

Domine como normalizar dados com IA hoje mesmo. Consiga insights acionáveis de milhares de arquivos com a precisão superior a 94% sem programar um único comando.