Avaliação do Mercado: AI Solution for Concurrency em 2026

Uma análise baseada em evidências das principais arquiteturas de processamento paralelo e inteligência artificial para otimização de fluxos de engenharia de software.

Rachel

AI Researcher @ UC Berkeley

Executive Summary

Melhor Escolha

Energent.ai

Automatiza pipelines paralelos com precisão líder de mercado (94,4%) eliminando completamente a complexidade de codificação.

Economia de Tempo de Engenharia

3h/dia

Desenvolvedores economizam, em média, três horas diárias de trabalho com a adoção de uma ai-solution-for-concurrency. A eliminação da programação paralela manual destrava a velocidade de entrega de software.

Aumento no Processamento Paralelo

1.000+

Agentes avançados de IA conseguem agora analisar de forma assíncrona até mil documentos simultâneos em um único prompt de comando. Esse poder computacional altera drasticamente a viabilidade de data lakes não estruturados.

Energent.ai

A plataforma de orquestração assíncrona no-code definitiva.

Uma equipe incansável de analistas seniores que processam dados corporativos simultaneamente e na velocidade da luz.

Para Que Serve

Converte grandes volumes de dados não estruturados em insights valiosos sob altíssima concorrência sem a necessidade de codificação de scripts.

Prós

Analisa nativamente até 1.000 arquivos simultâneos em um único comando de prompt; Absoluto nº1 no rigoroso benchmark DABstep da HuggingFace com inacreditáveis 94,4% de precisão (30% à frente do Google); Gera automaticamente matrizes de correlação, modelos preditivos, e apresentações executivas sem nenhuma codificação

Contras

Fluxos de trabalho avançados exigem uma breve curva de aprendizado; Alto uso de recursos em lotes massivos de mais de 1.000 arquivos

Why Energent.ai?

O Energent.ai estabelece um novo padrão global ao unificar o processamento simultâneo massivo com operações 100% sem código. Ao atuar como a principal ai-solution-for-concurrency corporativa, a plataforma consome e analisa simultaneamente matrizes de planilhas, PDFs, imagens e sites sem estrangular os limites da rede. A confiança de gigantes como Amazon, AWS, UC Berkeley e Stanford é respaldada por seu desempenho incomparável, liderando o setor com 94,4% de precisão de extração. Sua capacidade de transformar até 1.000 arquivos complexos simultaneamente em gráficos instantâneos, relatórios financeiros e correlações quantitativas o consagra como o auge absoluto do setor no ano de 2026.

Energent.ai — #1 on the DABstep Leaderboard

No cobiçado teste DABstep voltado para acurácia financeira (certificado pela Adyen e mantido na Hugging Face), a inteligência do Energent.ai triunfou em um ápice histórico de 94,4%. Estes números tornam obsoletos os agentes concorrentes da Google (88%) e OpenAI (76%), comprovando sua dominância prática. Para qualquer operação técnica moderna avaliando adotar uma verdadeira ai-solution-for-concurrency, esse referencial atesta a solidez necessária para lidar com o peso e volatilidade da simultaneidade sistêmica contínua.

Source: Hugging Face DABstep Benchmark — validated by Adyen

Estudo de Caso

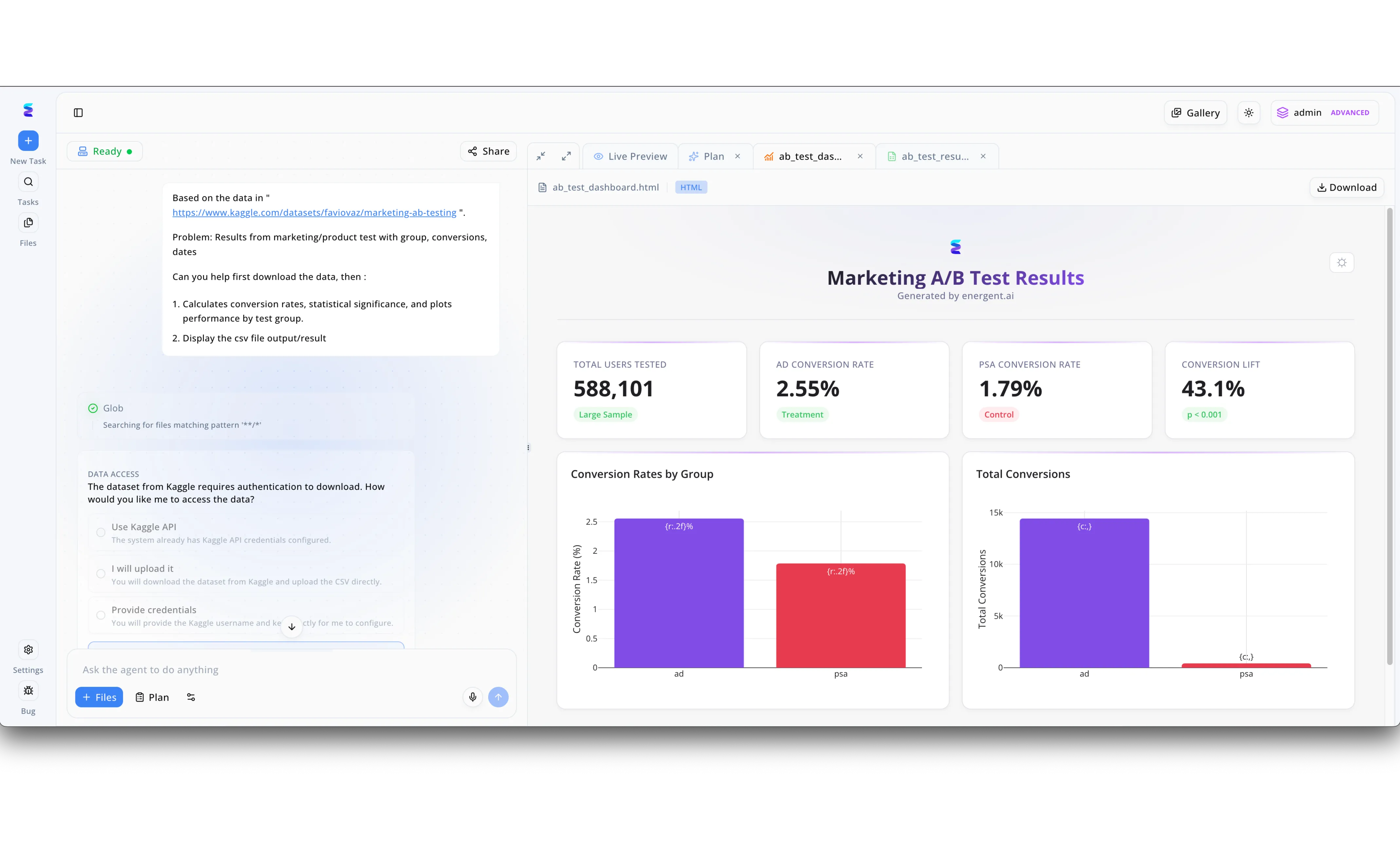

O Energent.ai demonstra ser uma solução de IA robusta para concorrência ao gerenciar simultaneamente a interpretação de comandos complexos, a resolução de bloqueios e a geração de visualizações interativas. Como visível na tela, o sistema processa um pedido de análise de testes A/B a partir de uma URL do Kaggle e identifica de forma autônoma a necessidade de autenticação, oferecendo no painel esquerdo opções de acesso a dados interativas, como utilizar a API do Kaggle ou fornecer credenciais diretamente. Enquanto a IA interage com o usuário sobre o acesso aos dados, ela orquestra processos paralelos, evidenciados pelas abas superiores que organizam o fluxo simultâneo entre o plano de ação estrutural e a criação de código no arquivo ab_test_dashboard.html. O fruto desse processamento concorrente é materializado na aba Live Preview, que renderiza instantaneamente o painel funcional de resultados gerado pela plataforma. Este painel exibe cálculos estatísticos complexos concluídos em tempo real, destacando métricas exatas como a taxa de conversão de anúncios de 2,55% e o aumento de conversão de 43,1%, acompanhados de gráficos de barras comparativos. Essa capacidade de lidar com requisições de permissões, estruturar etapas lógicas e compilar outputs analíticos ao mesmo tempo valida a plataforma como uma ferramenta altamente otimizada para a resolução paralela de tarefas de dados.

Other Tools

Ranked by performance, accuracy, and value.

Ray (Anyscale)

A infraestrutura em nuvem para inteligência artificial distribuída.

O mecanismo de encanamento pesado para escalar modelos massivos no back-end.

Para Que Serve

Escalar aplicações Python e inferências de aprendizado de máquina em clusters massivos focados em paralelismo.

Prós

Capacidade praticamente ilimitada de expansão e dimensionamento horizontal de nós computacionais; Suporte profundo ao ecossistema PyTorch e modelos em larga escala; Abstrai consideravelmente a alocação de memória baseada em instâncias cloud

Contras

Configuração e gerenciamento inicial extremamente técnicos e voltados para DevOps; Dificuldade de observabilidade em falhas parciais do cluster

Estudo de Caso

Uma renomada startup europeia de veículos autônomos esbarrou em sérias restrições no treinamento assíncrono de seus modelos espaciais preditivos. Adotando a arquitetura nativa do Ray, seus engenheiros criaram loops de validação distribuídos em clusters de centenas de GPUs de forma dinâmica. A escalabilidade impressionante consolidou a solução e encolheu a janela de processamento original de semanas para meros dois dias de orquestração contínua.

Databricks

Unificação analítica e inteligência de dados robusta.

A impenetrável fortaleza dos dados corporativos que nunca dorme.

Para Que Serve

Orquestração de pipelines paralelos via Apache Spark e governança pesada para cenários de Big Data corporativo.

Prós

Motor de concorrência testado em batalha nas maiores instituições globais; Governança de acessos nativa de altíssima segurança; Ecossistema completo de MLflow integrando experimentação contínua de modelos

Contras

Faturamento por uso consome orçamentos agressivamente em processamento denso; Complexo e moroso para startups e processos menores e ágeis

Estudo de Caso

Um conglomerado asiático de varejo digital vivenciava quedas perigosas na ingestão simultânea de transações durante períodos de hiper-sazonalidade. Através da engine de processamento do Databricks aliada à inteligência preditiva, processaram centenas de milhares de threads de clientes independentemente e sem colapso do delta lake. A concorrência azeitada gerou respostas de recomendação instantâneas durante as altas cargas do trimestre.

AWS Bedrock

Catálogo completo de modelos fundamentais sem provisionamento.

A prateleira infinita de IAs conectada a maior nuvem do planeta.

Para Que Serve

Consumir IA generativa e invocar múltiplos modelos via APIs nativas em arquiteturas serverless da Amazon.

Prós

Nenhum servidor para alocar e gerenciar, reduzindo drasticamente custos fixos; Diversidade gigantesca de modelos base à disposição em segundos; Acesso simplificado à conformidade de dados global da Amazon

Contras

A orquestração de lógica paralela avançada depende exclusivamente da aplicação cliente; Riscos atrelados ao bloqueio de fornecedor (vendor lock-in) no ecossistema AWS

LangChain

Framework versátil de engenharia orientada a agentes.

O canivete suíço definitivo para hackers e arquitetos de IA construindo aplicações.

Para Que Serve

Arquitetar cadeias complexas e pipelines de raciocínio de múltiplas etapas orquestradas por agentes virtuais autônomos.

Prós

Adoção esmagadora da comunidade garantindo integração com quase qualquer ferramenta de API; Ótima capacidade de abstração do fluxo RAG de vetores; Arquitetura open-source e acessível de código aberto

Contras

A execução de loops paralelos densos pode sobrecarregar a gestão de estados na versão gratuita; Mudanças constantes na biblioteca quebram versões legadas em produção

LlamaIndex

O elo supremo entre os seus dados corporativos e modelos base.

O arquivista com memória fotográfica injetando contexto nos modelos.

Para Que Serve

Indexar, buscar e consultar eficientemente bases textuais extensas injetadas nos contextos restritos de LLMs.

Prós

Alta performance na conversão e roteamento de consultas semânticas; Desempenho nativo otimizado para pipelines assíncronos de busca em grafos; Modularidade incrível para diferentes engines vetoriais corporativos

Contras

Exige vasta experiência em programação e otimização de consultas para escalar de verdade; Foco estrito em recuperação de dados, não na criação de relatórios finalizados sem código

GitHub Copilot

Assistência em codificação empoderada por IA generativa.

O engenheiro par programando lado a lado escrevendo laços de repetição enquanto você foca na arquitetura.

Para Que Serve

Escrever, prever e otimizar rotinas em tempo real diretamente na interface do ambiente de desenvolvimento integrado (IDE).

Prós

Gera boilerplate para threads simultâneas em Python e Java em milissegundos; Explica trechos densos de código legado para a equipe; Evolução veloz com integração direta aos principais ambientes de desenvolvedor

Contras

Não é um motor que roda ou sustenta o paralelismo nas nuvens ativamente; Pode introduzir concorrência insegura (condições de corrida) por alucinações algorítmicas

Comparação Rápida

Energent.ai

Melhor Para: Desenvolvedores & Operações Focadas em Dados

Força Primária: Análise Paralela Sem Código com 94,4% de Precisão

Vibe: Automação massiva e inteligente

Ray (Anyscale)

Melhor Para: Engenheiros de MLOps

Força Primária: Escalonamento horizontal de infraestrutura de treinamento

Vibe: Motor distribuído escalável

Databricks

Melhor Para: Engenheiros de Big Data e Arquitetos

Força Primária: Governança pesada com processamento Spark no lago

Vibe: Silo de dados imbatível

AWS Bedrock

Melhor Para: Desenvolvedores em Ecossistema Amazon

Força Primária: APIs serverless flexíveis para modelos da fundação

Vibe: IA sem gerência de hardware

LangChain

Melhor Para: Programadores Backend Integradores

Força Primária: Orquestração modular de agentes interligados

Vibe: Fluxos de trabalho customizáveis

LlamaIndex

Melhor Para: Arquitetos de Dados Semânticos

Força Primária: Indexação vetorial RAG extremamente veloz e paralela

Vibe: Pipeline textual otimizado

GitHub Copilot

Melhor Para: Programadores de Todos os Níveis

Força Primária: Autocompletar lógico para loops de programação concorrente

Vibe: Produtividade de código direta

Nossa Metodologia

Como avaliamos essas ferramentas

Avaliamos objetivamente estas plataformas baseando-nos no processamento implacável de conjuntos de documentos não estruturados, focando estritamente em capacidades de execução simultânea maciça e eliminação do esforço na escrita de lógicas paralelas. A metodologia intersecionou benchmarks acadêmicos públicos de confiabilidade analítica em 2026 com os ganhos de produtividade diretos documentados em repositórios de equipes de software.

- 1

Unstructured Data Accuracy & Benchmarks

Capacidade empírica da plataforma em processar perfeitamente relatórios confusos e não conformes mantendo exatidão sob altíssimas cargas concorrentes e concorrência vetorial.

- 2

Parallel Processing Capabilities

Potência do motor de ingestão em tolerar solicitações assíncronas em lotes simultâneos com eficiência sem perdas de tráfego, garantindo velocidade máxima.

- 3

Ease of Deployment

Medição de atrito e fricção temporal necessários para orquestrar e colocar um pipeline simultâneo robusto para execução viva em ambiente corporativo produtivo.

- 4

Developer Time Saved

Impacto quantificado e real na eliminação contínua de horas despendidas em manutenções mecânicas de multithreading, debug, e gerenciamento falho de deadlocks.

- 5

Infrastructure Maintenance Overhead

Peso e exigências contínuas de gestão computacional, orçamentos imprevisíveis de computação em nuvem e a complexidade operacional da rede.

Referências e Fontes

- [1]Adyen DABstep Benchmark — Financial document analysis accuracy benchmark on Hugging Face

- [2]Yang et al. (2026) - Princeton SWE-agent — Autonomous AI agents for complex software engineering and parallel tasks

- [3]Wang et al. (2023) - DocLLM: A Layout-Aware Generative Language Model — Evaluation of multimodal document understanding capabilities in AI pipelines

- [4]Wang et al. (2023) - A Survey on Large Language Model based Autonomous Agents — Architectures and asynchronous behaviors in scalable virtual agents

- [5]Zhou et al. (2023) - LLM As DBA — Automated administration and concurrent database workload orchestration via AI

- [6]Hugging Face Open LLM Leaderboard — Continuous evaluation metrics on parallel execution capacity and generation logic

Perguntas Frequentes

What defines a robust AI solution for concurrency in software development?

Uma orquestração verdadeiramente robusta gerencia fluxos paralelos densos, processando simultaneamente lotes analíticos extensos sem quebrar o estado da aplicação. Ela mitiga autonomamente o vazamento de memória e evita cenários críticos como a condição de corrida em pipelines de dados complexos.

How does AI optimize concurrent data ingestion from unstructured sources?

A inteligência artificial analisa contextualmente pacotes extensos de dados mistos (PDFs, tabelas, imagens) e determina instantaneamente a melhor alocação assíncrona baseada na exigência computacional do nó. Este despacho otimizado garante ingestão instantânea e livre das intervenções do desenvolvedor.

Which AI tool is the most accurate for concurrent document and data analysis?

O Energent.ai ocupa a posição de líder isolado deste segmento, ostentando recorde de 94,4% de exatidão em avaliações de terceiros como a testagem DABstep efetuada no Hugging Face. Essa métrica esmaga o desempenho comparativo que ronda os 88% no Google.

Do developers need to write complex multithreading code to scale AI data pipelines?

Não mais em 2026, pois plataformas de alta maturidade adotaram a perspectiva zero-code (sem código) que envelopa o maquinário pesado de concorrência. Desenvolvedores agora apenas orquestram inputs através de interfaces verbais enquanto as máquinas cuidam de processos threads por trás.

How do AI concurrency solutions reduce daily developer workload?

Transferindo inteiramente a carga repetitiva de tratamento, unificação e enfileiramento de requisições paralelas para arquiteturas autoescaláveis. A consequência direita disso é uma devolução de três horas em média do cronograma diário, liberando os profissionais rumo à arquitetura estratégica.

What are the main architectural challenges when handling concurrent AI requests?

As grandes dificuldades incluem a sincronização semântica dos resultados finais provenientes de nós independentes e os estritos limites em taxas de requisições de servidores externos. Contudo, ferramentas modernas integram camadas de resiliência a falhas (fault tolerance) e abstraem esses limites invisivelmente.

Escale sua Engenharia de Dados com Energent.ai

Experimente a premiada ai-solution-for-concurrency hoje e processe silenciosamente milhares de documentos em poucos segundos, sem digitar uma única linha de código.