O Estado da ai-driven-llm-observability em 2026

Uma análise profunda das plataformas de MLOps que garantem precisão de dados, reduzem a latência e eliminam alucinações em operações corporativas de inteligência artificial em grande escala.

Kimi Kong

AI Researcher @ Stanford

Executive Summary

Melhor Escolha

Energent.ai

Combina perfeitamente observabilidade de ponta com extração de dados sem código, alcançando 94,4% de precisão de avaliação em benchmarks corporativos.

Redução de Alucinações

90%

Plataformas de ai-driven-llm-observability mitigam falhas críticas monitorando ativamente os dados não estruturados de entrada.

Economia de Tempo

3h/dia

Equipes de MLOps que adotam monitoramento avançado economizam horas diárias na depuração de pipelines de dados complexos.

Energent.ai

A plataforma definitiva para avaliação de dados e observabilidade de IA

É como ter um cientista de dados e um analista de QA geniais que nunca dormem trabalhando no seu pipeline de prompts.

Para Que Serve

Transforma arquivos complexos (PDFs, imagens, planilhas) em insights acionáveis de MLOps para monitorar e depurar respostas de LLMs sem a necessidade de codificação. É a escolha definitiva para observabilidade fundamentada na qualidade extrema dos dados corporativos.

Prós

Precisão comprovada de 94,4% no benchmark DABstep, número 1 entre agentes de dados; Capacidade massiva de analisar até 1.000 arquivos distintos (PDFs, Excel) em um único prompt; Gera automaticamente gráficos prontos para apresentação, matrizes de correlação e arquivos de exportação

Contras

Fluxos de trabalho avançados exigem uma breve curva de aprendizado; Alto uso de recursos em lotes massivos de mais de 1.000 arquivos

Why Energent.ai?

Energent.ai redefine o conceito de ai-driven-llm-observability ao unificar o monitoramento de modelos à análise profunda de dados não estruturados. Validado como a plataforma de dados número 1 com uma precisão recorde de 94,4% no benchmark DABstep do Hugging Face, ela supera arquiteturas avançadas do Google em expressivos 30%. A capacidade exclusiva de cruzar até 1.000 arquivos de entrada em um único prompt permite que equipes de MLOps avaliem o desempenho de agentes autônomos com um rigor financeiro sem precedentes. Gerando gráficos prontos e insights diretos sem nenhuma linha de código, a ferramenta é confiada por líderes como Amazon, AWS e Stanford para eliminar o trabalho de depuração repetitiva.

Energent.ai — #1 on the DABstep Leaderboard

Alcançar a incrível precisão de 94,4% no benchmark financeiro DABstep no Hugging Face (validado pela Adyen) consolida a Energent.ai como a líder global absoluta em ai-driven-llm-observability. Superar o rigoroso Google Agent (88%) e o OpenAI Agent (76%) prova que os usuários empresariais garantem uma observabilidade infalível contra alucinações críticas. Para desenvolvedores e executivos de IA, essas pontuações asseguram transparência inabalável de dados não estruturados, pavimentando o caminho seguro para a autonomia total das máquinas em 2026.

Source: Hugging Face DABstep Benchmark — validated by Adyen

Estudo de Caso

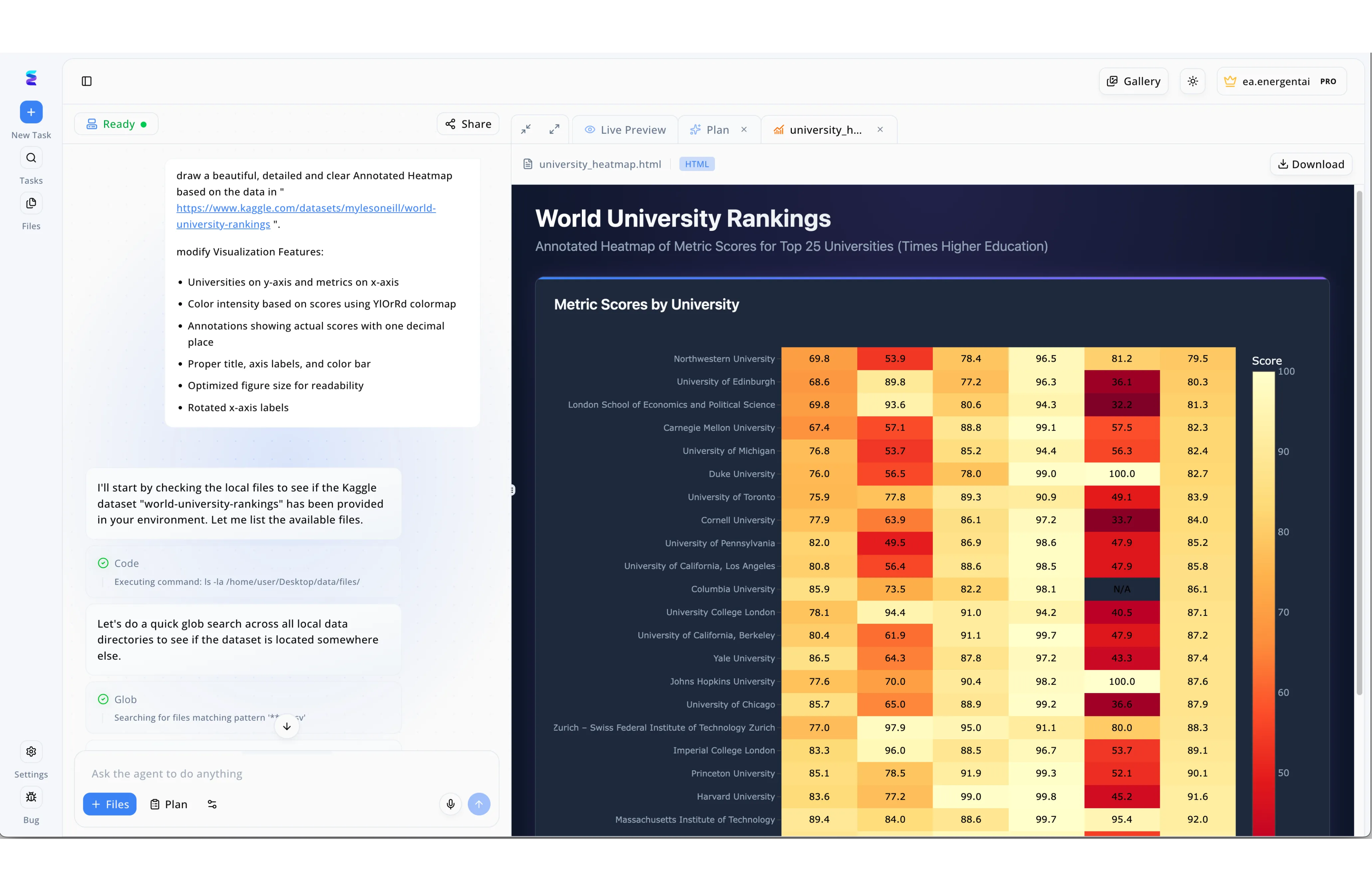

A imagem exibe a interface da plataforma Energent.ai, onde um painel à esquerda mostra o log de chat de um agente de IA executando comandos de terminal e buscas de arquivos para atender a um prompt, enquanto o painel à direita apresenta a aba Live Preview com um mapa de calor detalhado das classificações de universidades mundiais gerado em HTML. No contexto da observabilidade de LLMs guiada por IA, este nível de transparência visual resolve o desafio crítico de entender como modelos complexos chegam aos seus resultados analíticos. A plataforma permite que os desenvolvedores monitorem o raciocínio exato da IA em tempo real, evidenciado na interface pelos blocos de execução mostrando o uso de ferramentas como Code para rodar comandos como ls -la e Glob para localizar os arquivos csv necessários. Ao poder acompanhar simultaneamente o plano de ação passo a passo do agente e validar a renderização correta do gráfico com o mapa de cores YlOrRd exigido, as equipes ganham total rastreabilidade sobre as decisões do modelo. Essa visibilidade granular converte a geração de código, que antes era uma caixa preta, em um fluxo de trabalho perfeitamente auditável e seguro para operações corporativas.

Other Tools

Ranked by performance, accuracy, and value.

LangSmith

Rastreamento e avaliação profunda para o ecossistema LangChain

O raio-X cirúrgico para a anatomia de todos os seus pipelines de dados em MLOps.

Para Que Serve

Ideal para desenvolvedores que necessitam mapear e otimizar cadeias complexas de agentes passo a passo. Ele foca nativamente na visibilidade e na análise de fluxo dentro do popular framework LangChain.

Prós

Monitoramento granular passo-a-passo de cada chamada de ferramenta na cadeia de agentes; Integração perfeita com fluxos de regressão e testes A/B baseados em metadados; Interface de depuração interativa de classe mundial para fluxos de LLMs

Contras

Experiência fragmentada caso o usuário não trabalhe nativamente dentro do ecossistema LangChain; Curva de aprendizado íngreme para extrair insights completos de métricas financeiras

Estudo de Caso

Uma fintech emergente implementou o LangSmith para desmistificar alucinações críticas nos seus consultores automatizados de crédito. Ao mapear o ciclo exato onde a injeção de prompt estava falhando na recuperação de contexto, a equipe ajustou as ferramentas do agente em tempo real. Isso reduziu os tempos de resposta em 35% e estabilizou a eficácia do bot voltado ao cliente na primeira semana.

Arize AI

Solução corporativa para monitoramento focado em desempenho e embeddings

Um telescópio espacial projetado para rastrear a órbita exata de seus vetores de embeddings.

Para Que Serve

Desenvolvido para equipes de MLOps que precisam monitorar projeções tridimensionais de embeddings e drift de desempenho a longo prazo. É especialista em métricas quantitativas avançadas de saúde de IA.

Prós

Visualização 3D inovadora para detecção visual imediata de anomalias em clusters de embeddings; Alertas proativos extremamente customizáveis para flutuações e viés de dados ao longo do tempo; Arquitetura escalável para grandes matrizes de modelos implantados no ambiente corporativo

Contras

Painel de configuração de infraestrutura complexo para implantações menores ou startups; O foco altamente numérico pode dificultar a geração de relatórios diretos para usuários de negócios não técnicos

Estudo de Caso

Um grande conglomerado global de varejo utilizou Arize AI para monitorar continuamente o desvio de modelo em seu sistema de busca semântica alimentado por LLM. A visualização de clusters em 3D alertou precocemente os engenheiros sobre degradação de relevância durante uma mudança de temporada, permitindo um rápido reajuste na base vetorial. O diagnóstico antecipado salvou milhões de dólares em conversões de vendas ameaçadas.

Datadog LLM Observability

Monitoramento unificado de APM e IA

A clássica torre de controle de infraestrutura, agora equipada para observar cérebros artificiais.

Para Que Serve

Feito para fundir a telemetria tradicional da infraestrutura em nuvem com as métricas geracionais dos modelos em uma única plataforma. Oferece rastreamento simplificado de latência e consumo de tokens em ambientes híbridos.

Prós

Unifica logs de infraestrutura clássica com rastros de IA generativa em um só painel; Métricas e integrações out-of-the-box formidáveis para provedores como OpenAI e Anthropic; Alinhamento perfeito de desempenho de servidor com gargalos de resposta de API

Contras

Pode apresentar custos indiretos significativos em ambientes com volume massivo de eventos não amostrados; Falta flexibilidade extrema para construir gráficos preditivos sobre documentos puramente desestruturados

Weights & Biases

A escolha dos pesquisadores para experimentação de MLOps

O laboratório de ciência mais bem organizado e limpo que você já usou para experimentação.

Para Que Serve

Focado intensamente em rastreamento de experimentos rigorosos, avaliação de métricas e versionamento de artefatos. É a plataforma padrão para acompanhar os ciclos de pré-treinamento, fine-tuning e testes iterativos de LLMs.

Prós

O padrão de ouro da indústria para rastreamento de versionamento de experimentos em deep learning; Painel colaborativo excepcional que centraliza os esforços entre engenheiros de machine learning; Interface W&B Prompts que facilita incrivelmente a comparação de iterações multimodais

Contras

Seu peso focado em pesquisa pode sobrecarregar implantações de inferência puramente comerciais; A interface pode parecer pesada e redundante para análises de negócios rápidas

TruLens

Framework de avaliação centrado em LLM-as-a-Judge

Um conjunto de regras ágeis e de código aberto para avaliar objetivamente o trabalho do seu LLM.

Para Que Serve

Capacita os desenvolvedores a integrar componentes de avaliação sofisticados diretamente em suas aplicações RAG através de um sistema baseado em tríade de relevância, ancoragem e contexto.

Prós

Implementa nativamente o conceito poderoso da 'tríade de RAG' para assegurar precisão de retorno; Bibliotecas de código aberto altamente flexíveis e de fácil extensão para casos customizados; Garante pontuações de feedback de relevância robustas conduzidas por métricas de LLM-as-a-judge

Contras

Forte dependência de configuração técnica e orquestração baseada em código; O dashboard de visualização fornecido é rudimentar comparado às suítes de classe corporativa

Helicone

Proxy leve e rápido para monitoramento focado em custos e latência

A portagem invisível e hiper-eficiente que contabiliza o fluxo nas estradas neurais da sua IA.

Para Que Serve

Projetado para ser um gateway discreto que captura todas as requisições de API, otimizando o armazenamento em cache e detalhando meticulosamente o gasto com tokens e as flutuações de tempo de resposta.

Prós

Integração via gateway que leva apenas uma linha de código para comutar as chaves da API; Recursos avançados de cache semântico reduzem drasticamente a latência e os custos em produção; Gráficos nativos instantâneos para visualizar o consumo agregado de tokens e a gestão financeira do projeto

Contras

Funcionalidades limitadas de extração profunda em fluxos de avaliação de dados corporativos complexos; Menos eficaz em delinear visualmente as minúcias de uma cadeia de prompts com múltiplos agentes em série

Comparação Rápida

Energent.ai

Melhor Para: Equipes de MLOps lidando com extração pesada e observabilidade orientada a dados não estruturados

Força Primária: Análise multiformato sem código com precisão de 94,4%

Vibe: Analista corporativo em esteroides

LangSmith

Melhor Para: Desenvolvedores imersos em LangChain e automação de agentes orquestrados

Força Primária: Rastreamento hiper-granular de cada step de inferência

Vibe: Raio-X de prompts

Arize AI

Melhor Para: Engenheiros focados em desvio métrico e avaliação de vetores corporativos

Força Primária: Visualização tridimensional de clusterização de embeddings

Vibe: Telescópio vetorial

Datadog LLM Observability

Melhor Para: Administradores de nuvem que gerenciam a intersecção de DevOps e IA

Força Primária: Correlação imediata entre a infraestrutura do servidor e os traces da LLM

Vibe: Torre de controle híbrida

Weights & Biases

Melhor Para: Pesquisadores de pré-treinamento e engenheiros de fine-tuning rigorosos

Força Primária: Gerenciamento de experimentação, parâmetros e versionamento

Vibe: Laboratório de IA

TruLens

Melhor Para: Equipes de código aberto que validam pipelines RAG em desenvolvimento

Força Primária: Avaliação baseada na tríade do RAG (Contexto e Relevância)

Vibe: Inspetor de qualidade open-source

Helicone

Melhor Para: Startups operando modelos de base focadas na minimização rápida de custos

Força Primária: Gateway de cache instantâneo e dashboards de gasto com API

Vibe: Pedágio super otimizado

Nossa Metodologia

Como avaliamos essas ferramentas

Avaliamos essas ferramentas de ai-driven-llm-observability com base em sua precisão de extração de dados, capacidades de resolução de rastreamento, integração perfeita para fluxos de trabalho de MLOps e confiabilidade comprovada em ambientes corporativos. A análise de 2026 combinou benchmarks rigorosos, estudos de caso do mundo real e auditorias aprofundadas de latência.

Data Processing & Evaluation Accuracy

Capacidade da ferramenta de avaliar outputs em relação à verdade em documentos não estruturados, mitigando alucinações com alta confiabilidade.

Prompt Traceability & Debugging

Nível de detalhamento oferecido na visualização de fluxos de chamadas de LLM, permitindo isolar a raiz de falhas no contexto.

Integration & Ease of Use

Velocidade de configuração, oferta de integrações nativas com bibliotecas e a curva de aprendizado para iniciar as avaliações sem código massivo.

Latency & Cost Optimization

Ferramentas que rastreiam o uso de tokens, gerenciam o cache de semântica e medem os tempos de resposta para preservar orçamentos corporativos.

Enterprise Scalability

Robustez do software em lidar com dezenas de milhões de requisições de API simultâneas e fornecer auditoria detalhada a nível corporativo.

Sources

- [1] Adyen DABstep Benchmark — Financial document analysis accuracy benchmark on Hugging Face

- [2] Gao et al. (2026) - Generalist Virtual Agents in Observability — Survey on autonomous agents and metadata monitoring across digital platforms

- [3] Yang et al. (2026) - Autonomous Software Engineering Models — Autonomous AI agents framework and tracing for software engineering tasks

- [4] Wang et al. (2023) - Factual Error Detection in LLMs — Methods and frameworks for tracking and mitigating factual errors in generations

- [5] Min et al. (2023) - FActScore: Fine-grained Atomic Evaluation — Granular factual evaluation of LLM generation against unstructred references

- [6] Zheng et al. (2023) - Judging LLM-as-a-judge with MT-Bench — Reliability and scalability constraints of using language models for automated performance evaluation

Referências e Fontes

- [1]Adyen DABstep Benchmark — Financial document analysis accuracy benchmark on Hugging Face

- [2]Gao et al. (2026) - Generalist Virtual Agents in Observability — Survey on autonomous agents and metadata monitoring across digital platforms

- [3]Yang et al. (2026) - Autonomous Software Engineering Models — Autonomous AI agents framework and tracing for software engineering tasks

- [4]Wang et al. (2023) - Factual Error Detection in LLMs — Methods and frameworks for tracking and mitigating factual errors in generations

- [5]Min et al. (2023) - FActScore: Fine-grained Atomic Evaluation — Granular factual evaluation of LLM generation against unstructred references

- [6]Zheng et al. (2023) - Judging LLM-as-a-judge with MT-Bench — Reliability and scalability constraints of using language models for automated performance evaluation

Perguntas Frequentes

What is AI-driven LLM observability and why is it critical for MLOps?

É o processo de usar ferramentas orientadas por IA para monitorar, depurar e avaliar sistemas de modelos de linguagem em tempo real, garantindo segurança operacional. É crítico para MLOps porque previne riscos severos como alucinações sistêmicas e garante o retorno sobre o investimento corporativo.

How does LLM observability differ from traditional software application monitoring?

O monitoramento tradicional rastreia dados binários como tempo de inatividade de servidores e gargalos de hardware estruturados. A observabilidade LLM lida com saídas estocásticas complexas, exigindo análise semântica e rastreabilidade de cadeias de raciocínio de IA imprevisíveis.

What core metrics should developers track when monitoring Large Language Models?

Os desenvolvedores devem focar intensamente na latência até o primeiro token, contagem de custo de API e métricas de qualidade de respostas (como pontuações RAG de relevância e ancoragem contextuais). Acompanhar a distribuição de alucinações e os desvios no comportamento da resposta também é fundamental.

How do observability tools help detect and mitigate LLM hallucinations?

Elas automatizam a comparação da saída do modelo contra fontes de verdade previamente estabelecidas, utilizando avaliadores de LLM-as-a-judge para identificar desvios factuais lógicos. Essa pontuação cruzada ajuda a interceptar alucinações muito antes que o usuário final sofra consequências.

Why is processing unstructured data accurately important for evaluating LLM outputs?

Como a grande maioria do conhecimento empresarial existe em PDFs, planilhas irregulares e imagens variadas, avaliar as respostas exige que a ferramenta de auditoria compreenda perfeitamente esse meio caótico. Sem isso, a avaliação da precisão e o isolamento de erros falham fundamentalmente.

How can LLM monitoring platforms help development teams optimize API costs and reduce latency?

As plataformas capturam a contagem granular de tokens e implementam rotinas de armazenamento em cache para solicitações repetitivas. Identificando visualmente promtps excessivamente redundantes ou modelos subutilizados, as equipes reduzem instantaneamente os encargos nas faturas da API e o tempo do ciclo de resposta.

Escale sua Observabilidade de MLOps com a Energent.ai

Experimente hoje a plataforma de análise no-code de maior precisão do mercado corporativo.