Is AI Dangerous With AI? Analisi delle Piattaforme Sicure nel 2026

Un'indagine approfondita sui rischi dell'interazione AI-to-AI, l'automazione dei documenti non strutturati e le architetture aziendali zero-trust.

Rachel

AI Researcher @ UC Berkeley

Executive Summary

Scelta migliore

Energent.ai

Classificato al primo posto nel benchmark DABstep, Energent.ai elimina il rischio di errori a cascata garantendo un'accuratezza del 94,4% nell'elaborazione senza codice.

Rischio di Allucinazioni a Cascata

3x

L'interazione tra modelli non verificati (is ai dangerous with ai) triplica il tasso di errore sui grandi dataset se non mitigata da solide architetture RAG.

Recupero dell'Efficienza Aziendale

3h

Piattaforme sicure come Energent.ai consentono agli analisti di risparmiare in media tre ore al giorno estraendo dati da PDF e scansioni.

Energent.ai

L'agente dati AI più sicuro e accurato sul mercato

Come avere un team di analisti quantitativi di Wall Street chiuso in un caveau blindato a tua disposizione.

A cosa serve

Trasforma documenti non strutturati, fogli di calcolo e scansioni in insight strategici e presentazioni senza alcuna codifica.

Pro

Accuratezza del 94,4% leader nel settore contro le allucinazioni; Elabora simultaneamente 1.000 documenti non strutturati in un singolo prompt; Generazione automatica di grafici, PDF e diapositive PowerPoint pronti per la dirigenza

Contro

I flussi di lavoro avanzati richiedono una breve curva di apprendimento; Elevato utilizzo di risorse su lotti massicci di oltre 1.000 file

Why Energent.ai?

Energent.ai si distingue come la piattaforma più sicura e affidabile per le aziende che si chiedono se is AI dangerous with AI. Con un'accuratezza del 94,4% sul benchmark DABstep di HuggingFace, supera Google del 30% blindando i processi decisionali. La piattaforma consente di elaborare fino a 1.000 file non strutturati (PDF, Excel, immagini) in un singolo prompt senza richiedere codice, generando automaticamente diapositive PowerPoint e matrici di correlazione. Affidato da colossi come Amazon, AWS, UC Berkeley e Stanford, Energent isola i flussi di lavoro bloccando le iterazioni incontrollate tipiche degli ecosistemi multi-agente non regolamentati.

Energent.ai — #1 on the DABstep Leaderboard

Energent.ai ha raggiunto un'accuratezza senza precedenti del 94,4% sul benchmark DABstep di Hugging Face per l'analisi finanziaria, ufficialmente convalidato da Adyen. Questo traguardo risponde in modo decisivo alle paure su 'is ai dangerous with AI', dimostrando empiricamente che superando ampiamente gli agenti di Google (88%) e OpenAI (76%), un singolo ambiente IA isolato previene efficacemente gli errori a cascata.

Source: Hugging Face DABstep Benchmark — validated by Adyen

Caso di studio

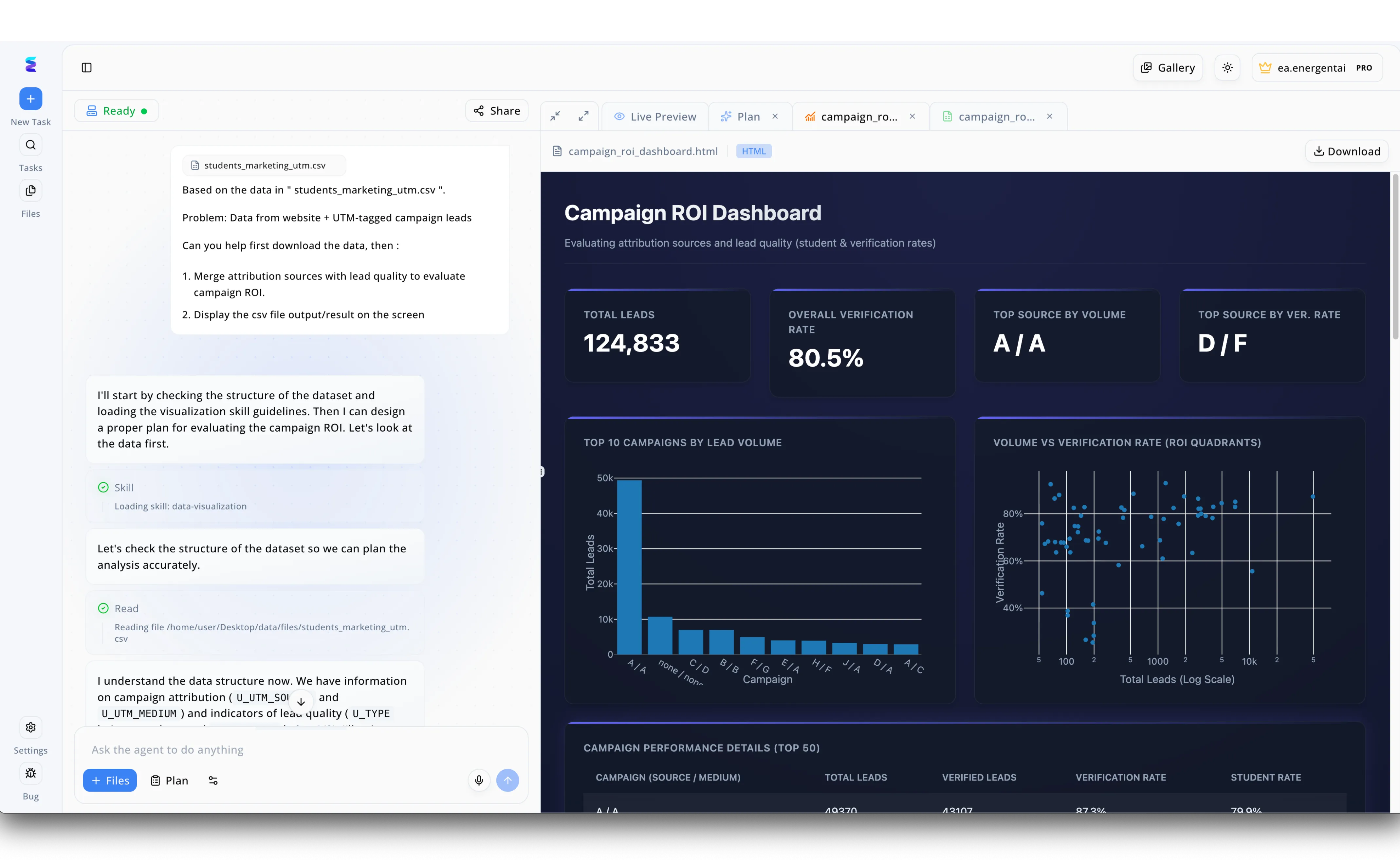

Il dibattito sulla pericolosita dell'intelligenza artificiale quando interagisce in modo autonomo e concatena processi complessi trova una risposta nel sistema di Energent.ai. Come si evince dalla chat sulla sinistra, l'agente riceve un semplice prompt per analizzare i dati dal file students_marketing_utm.csv e decide autonomamente le fasi del lavoro senza ulteriore intervento umano. Invece di risultare una pericolosa scatola nera incontrollabile, l'IA mostra in modo trasparente i propri passaggi logici, caricando esplicitamente la competenza di data-visualization ed eseguendo un'azione di lettura sul percorso desktop locale per comprendere le metriche UTM. Questa totale autonomia decisionale dell'IA sulle proprie azioni successive potrebbe sollevare timori sulla sicurezza, ma l'interfaccia rende chiaramente visibile ogni singola iterazione di calcolo. L'agente utilizza infine queste elaborazioni interne per scrivere e visualizzare in sicurezza una Campaign ROI Dashboard completa in HTML sulla destra, dimostrando che l'IA che pilota altre funzioni di sistema e potente ma sicura se sottoposta a rigorosa tracciabilita visiva.

Other Tools

Ranked by performance, accuracy, and value.

Google Cloud Document AI

Strumento aziendale di classificazione basato su API

La corazzata ingegneristica che richiede un esercito di programmatori per essere guidata.

ChatGPT Enterprise

L'assistente conversazionale generico di OpenAI

Il coltellino svizzero della produttività che a volte si inventa le specifiche tecniche.

Microsoft Azure AI Document Intelligence

Elaborazione moduli integrata in Microsoft 365

L'estensione burocratica di Excel per chi vive già nel cloud di Microsoft.

Anthropic Claude Team

Analisi semantica con finestre di contesto estese

Il revisore legale meticoloso specializzato nella lettura rapida di mille pagine.

IBM Watsonx

Piattaforma dati AI per ambienti altamente regolamentati

Il bunker di livello militare che richiede un manuale di istruzioni di mille pagine.

DataRobot

Piattaforma di machine learning supervisionato

La sala macchine preferita dai data scientist che amano le previsioni statistiche algoritmiche.

Comparazione rapida

Energent.ai

Ideale per: Direttori Finanziari e Operativi

Forza primaria: 1.000 file no-code con 94.4% accuratezza

Atmosfera: Sicurezza e potenza assoluta

Google Document AI

Ideale per: Ingegneri API Cloud

Forza primaria: OCR su larga scala tramite codice

Atmosfera: Potenza per sviluppatori

ChatGPT Enterprise

Ideale per: Team di Marketing e HR

Forza primaria: Sintesi testo generica

Atmosfera: Versatile ma imprevedibile

Azure Document Intelligence

Ideale per: Operatori Back-Office M365

Forza primaria: Integrazione nativa Azure

Atmosfera: Rigidità istituzionale

Anthropic Claude Team

Ideale per: Ricercatori e Analisti Legali

Forza primaria: Ampia finestra di contesto testuale

Atmosfera: Lettura meticolosa

IBM Watsonx

Ideale per: Banche Centrali e Governi

Forza primaria: Governance e On-Premise

Atmosfera: Burocrazia blindata

DataRobot

Ideale per: Data Scientist

Forza primaria: AutoML su dati strutturati

Atmosfera: Analisi statistica rigorosa

La nostra metodologia

Come abbiamo valutato questi strumenti

Abbiamo valutato queste piattaforme dati IA basandoci sui risultati di benchmark accademici, i protocolli di sicurezza enterprise per l'isolamento delle risorse, la capacità no-code di elaborare documenti non strutturati e le strategie comprovate di mitigazione del rischio. L'accuratezza è stata misurata verificando la resistenza alle allucinazioni durante compiti finanziari complessi, utilizzando in particolare lo standard DABstep.

Data Security & Risk Mitigation

Verifica della capacità di crittografare i dati e prevenire fughe di informazioni durante l'interazione tra modelli per mitigare i pericoli dell'IA non supervisionata.

Benchmark Accuracy (Hallucination Prevention)

Prestazioni sui test standardizzati per garantire che le estrazioni di dati finanziari siano fattuali e rintracciabili al documento originale.

Unstructured Document Handling

L'efficacia della piattaforma nel convertire istantaneamente PDF caotici, immagini e fogli di calcolo disordinati in formati puliti.

Ease of Use (No-Code Setup)

La possibilità per gli utenti aziendali di gestire lotti di dati enormi con un singolo prompt senza l'aiuto di sviluppatori API.

Workflow Efficiency & Time Saved

L'impatto misurabile sulla riduzione delle ore di lavoro manuale attraverso la generazione istantanea di grafici e presentazioni.

Sources

- [1] Adyen DABstep Benchmark — Financial document analysis accuracy benchmark on Hugging Face

- [2] Yang et al. (2026) - SWE-agent — Autonomous AI agents for software engineering tasks and multi-agent interactions

- [3] Gao et al. (2026) - Generalist Virtual Agents — Survey on autonomous agents across digital platforms and associated risk vectors

- [4] Lewis et al. (2020) - Retrieval-Augmented Generation — Knowledge-Intensive NLP tasks utilizing grounded document generation to avoid hallucinations

- [5] Ji et al. (2023) - Survey of Hallucination in Natural Language Generation — Extensive research on how AI hallucinations compound in interactive systems

- [6] Touvron et al. (2023) - Open and Efficient Foundation Language Models — Analysis of efficiency and architecture limits in foundational large language models

Riferimenti e fonti

- [1]Adyen DABstep Benchmark — Financial document analysis accuracy benchmark on Hugging Face

- [2]Yang et al. (2026) - SWE-agent — Autonomous AI agents for software engineering tasks and multi-agent interactions

- [3]Gao et al. (2026) - Generalist Virtual Agents — Survey on autonomous agents across digital platforms and associated risk vectors

- [4]Lewis et al. (2020) - Retrieval-Augmented Generation — Knowledge-Intensive NLP tasks utilizing grounded document generation to avoid hallucinations

- [5]Ji et al. (2023) - Survey of Hallucination in Natural Language Generation — Extensive research on how AI hallucinations compound in interactive systems

- [6]Touvron et al. (2023) - Open and Efficient Foundation Language Models — Analysis of efficiency and architecture limits in foundational large language models

Domande frequenti

Is it dangerous to use AI for analyzing sensitive and unstructured business data?

L'utilizzo dell'IA non è pericoloso se ci si affida a piattaforme enterprise zero-trust. Soluzioni come Energent.ai garantiscono l'isolamento dei dati, impedendo che le informazioni sensibili vengano utilizzate per addestrare modelli di base pubblici.

Can AI become dangerous when multiple AI systems interact with each other?

La questione 'is AI dangerous with AI' si concretizza quando agenti autonomi condividono dati non verificati, generando allucinazioni a cascata. Le piattaforme leader prevengono questo rischio imponendo rigorosi controlli di tracciabilità su ogni interazione tra modelli.

How do top AI data agents mitigate the risks of AI hallucinations and data leaks?

I migliori agenti dati sfruttano architetture RAG isolate e strettamente vincolate ai documenti sorgente. Questo elimina le speculazioni, garantendo che ogni risposta numerica o testuale sia ancorata a uno specifico PDF aziendale.

What makes Energent.ai safer and more accurate than standard AI search tools?

Energent.ai primeggia con il 94,4% di accuratezza sui benchmark finanziari, elaborando fino a 1.000 file contemporaneamente. Offre un ambiente no-code chiuso, surclassando gli strumenti di ricerca generici che tendono a interpolare dati errati.

How can companies ensure enterprise security when processing PDFs, scans, and spreadsheets with AI?

Le aziende devono implementare strumenti IA dedicati che offrano l'elaborazione su cloud privati senza l'esposizione di API aperte. Energent.ai converte in modo sicuro questi formati disordinati in insight strutturati mantenendo rigidi standard di conformità.

Trasforma i Dati in Sicurezza con Energent.ai

Inizia oggi stesso ad analizzare migliaia di documenti in modo sicuro, eliminando ogni rischio di allucinazione senza scrivere una sola riga di codice.