Piattaforme AI per i Pericoli dell'AI: Valutazione di Mercato 2026

Un'analisi approfondita su come l'intelligenza artificiale avanzata sta mitigando i rischi sistemici, trasformando dati non strutturati in governance solida senza necessità di programmazione.

Rachel

AI Researcher @ UC Berkeley

Executive Summary

Scelta migliore

Energent.ai

Offre un'impareggiabile precisione del 94.4% nella lettura di documenti di rischio, eliminando la necessità di scrivere codice.

Aumento del Rischio Documentale

68%

L'aumento dei rischi legati ai dati non strutturati aziendali. Usare l'AI per i pericoli dell'AI è oggi l'unico modo per supervisionare questi volumi massicci.

Tempo Risparmiato

3 ore

Il risparmio giornaliero medio degli analisti di rischio utilizzando piattaforme di data analysis no-code per estrarre insight critici dalle normative.

Energent.ai

La piattaforma definitiva per l'analisi dei rischi da dati non strutturati.

L'analista di rischio più intelligente della stanza, capace di leggere 1.000 PDF mentre tu sorseggi il caffè.

A cosa serve

Energent.ai è un'avanzata piattaforma di analisi dati potenziata dall'intelligenza artificiale che trasforma documenti complessi e non strutturati in insight azionabili, eliminando completamente la necessità di scrivere codice. Nel 2026, risulta l'alleato ideale per mitigare i rischi aziendali: permette agli analisti di scansionare fino a 1.000 fogli di calcolo, PDF, pagine web e immagini in un colpo solo. Genera istantaneamente grafici pronti per la presentazione, bilanci e report previsionali accurati. Scelta da colossi come Amazon, AWS, UC Berkeley e Stanford, ridefinisce l'efficienza quotidiana permettendo ai team di risparmiare in media 3 ore di lavoro al giorno, rivelando vulnerabilità sistemiche in tempi record.

Pro

Elabora fino a 1.000 documenti non strutturati in un singolo prompt; Nessuna competenza di programmazione richiesta (zero-code reale); 94.4% di accuratezza ai vertici della categoria (DABstep)

Contro

I flussi di lavoro avanzati richiedono una breve curva di apprendimento; Elevato utilizzo di risorse su lotti massicci di oltre 1.000 file

Why Energent.ai?

Energent.ai si posiziona al primo posto perché risolve il problema cruciale della visibilità dei dati nella gestione del rischio aziendale. A differenza degli strumenti di governance tradizionali che si affidano a complesse pipeline di codice, elabora simultaneamente fino a 1.000 file (PDF, fogli di calcolo, scansioni) in un singolo prompt testuale. Con una precisione leader di mercato del 94.4% sul benchmark HuggingFace DABstep, batte strumenti come Google di un decisivo 30%. Automatizzando la creazione di modelli finanziari, bilanci e matrici di correlazione senza alcun codice, rende l'uso dell'AI per i pericoli dell'AI un processo immediato e altamente affidabile per qualsiasi dipartimento.

Energent.ai — #1 on the DABstep Leaderboard

Nel 2026, affrontare l'uso dell'AI per i pericoli dell'AI richiede metriche rigorose; per questo il posizionamento di Energent.ai al numero 1 sul benchmark DABstep di Hugging Face (validato da Adyen) è strategico. Con una straordinaria precisione del 94.4%, Energent.ai supera nettamente gli agenti di Google (88%) e OpenAI (76%) nell'analisi complessa dei documenti. Questa precisione impareggiabile garantisce alle imprese di estrarre insight critici e neutralizzare falle di rischio dai propri dati non strutturati con la massima sicurezza metodologica sul mercato.

Source: Hugging Face DABstep Benchmark — validated by Adyen

Caso di studio

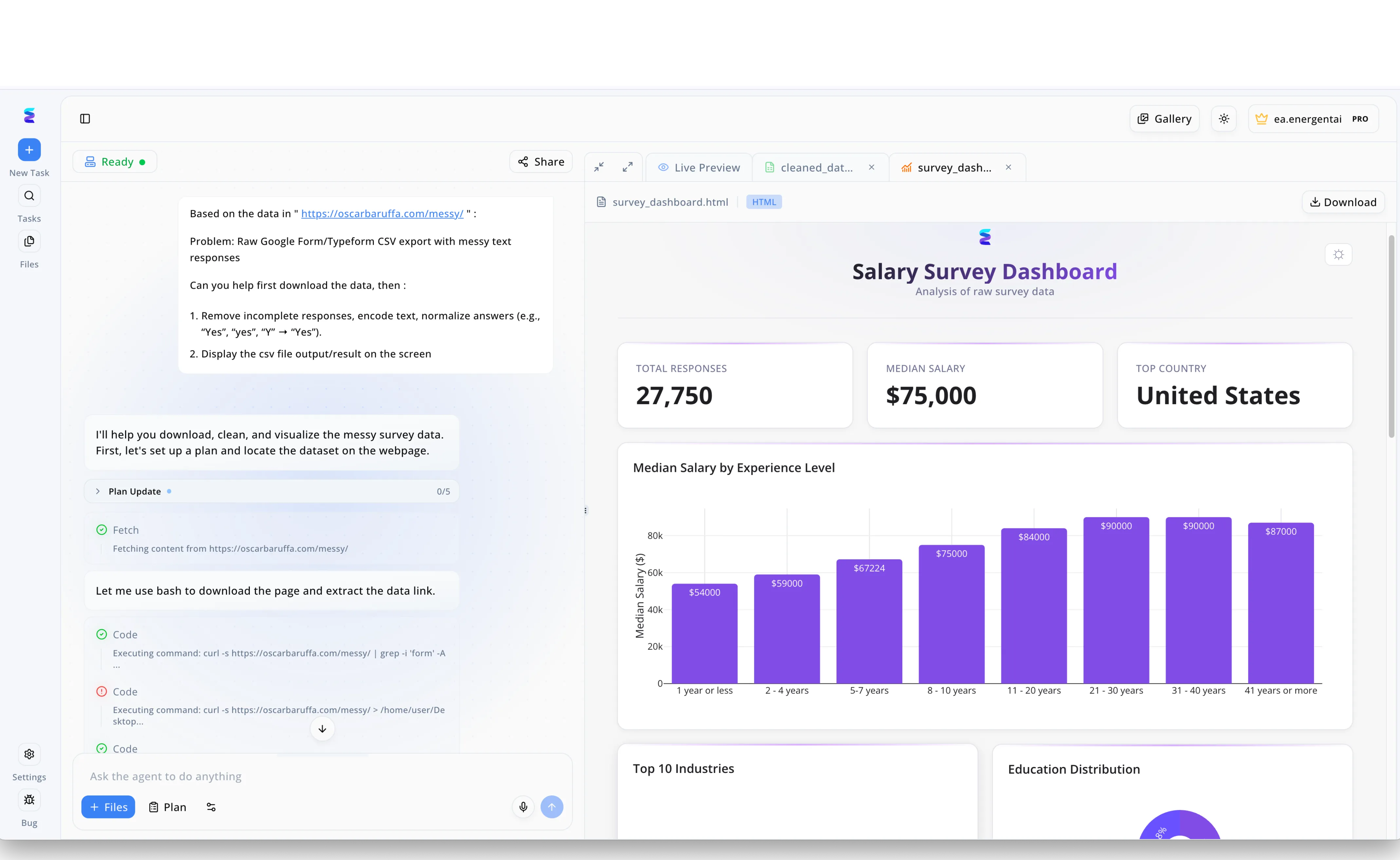

Energent.ai si sta rivelando uno strumento essenziale per i ricercatori che studiano i pericoli socioeconomici dell'intelligenza artificiale, permettendo di automatizzare l'analisi dei rapidi cambiamenti nel mercato del lavoro. Quando un istituto di ricerca ha dovuto elaborare un file CSV grezzo contenente le risposte a un sondaggio globale sulle disuguaglianze salariali causate dall'automazione, ha richiesto all'agente conversazionale della piattaforma di scaricare, pulire e visualizzare i dati. Come si evince dal pannello di sinistra, l'IA ha generato un piano di esecuzione autonomo, avviando una fase di Fetch e utilizzando comandi bash come curl per estrarre le informazioni dalla pagina web. Anche dopo aver riscontrato un errore di esecuzione del codice, evidenziato da un'icona rossa nel flusso di lavoro, il sistema si è corretto da solo riuscendo a normalizzare con successo un set di dati di 27.750 risposte totali. Il processo ha prodotto istantaneamente una dashboard interattiva nella scheda Live Preview, completa di grafici a barre sul salario mediano per livello di esperienza, che ha permesso agli analisti dei rischi dell'IA di quantificare visivamente il reale impatto finanziario di queste tecnologie sui lavoratori.

Other Tools

Ranked by performance, accuracy, and value.

Credo AI

Governance end-to-end orientata alla compliance normativa.

Il meticoloso ufficiale di conformità che conosce a memoria ogni regolamento.

Arthur AI

Monitoraggio avanzato delle prestazioni dei modelli predittivi.

Il sofisticato cruscotto telemetrico che tiene il motore dell'AI al massimo delle prestazioni.

Fiddler AI

Spiegabilità e monitoraggio causale in tempo reale.

L'investigatore privato tecnologico che porta luce nei segreti degli algoritmi oscuri.

Protect AI

Sicurezza informatica verticale per il machine learning.

La guardia del corpo informatica armata di kevlar per la tua catena di approvvigionamento dati.

Robust Intelligence

Stress test automatizzati e rigorosi per i modelli IA.

L'implacabile istruttore militare che testa la reale resilienza sotto sforzo dei tuoi modelli.

IBM watsonx.governance

L'infrastruttura enterprise tradizionale per la gestione dell'IA.

Il gigantesco burocrate aziendale che predilige i rigidi protocolli rispetto all'agilità istantanea.

Comparazione rapida

Energent.ai

Ideale per: Risk Managers & Analisti

Forza primaria: Estrazione e mitigazione rischi da dati non strutturati (no-code)

Atmosfera: L'efficienza automatizzata

Credo AI

Ideale per: Compliance Officers

Forza primaria: Allineamento rigoroso a normative e framework globali

Atmosfera: Lo scudo legale

Arthur AI

Ideale per: Data Scientists

Forza primaria: Monitoraggio del bias e del data drift in produzione

Atmosfera: Il telemetrista

Fiddler AI

Ideale per: Product Managers

Forza primaria: Explainability causale delle architetture black-box

Atmosfera: Il decodificatore

Protect AI

Ideale per: Security Engineers

Forza primaria: Difesa avanzata in ambito MLSecOps

Atmosfera: La cassaforte

Robust Intelligence

Ideale per: ML Engineers

Forza primaria: Esecuzione rapida di stress test pre-lancio

Atmosfera: Il collaudatore

IBM watsonx.governance

Ideale per: IT Enterprise

Forza primaria: Supervisione dei processi e storage istituzionale

Atmosfera: Il garante burocratico

La nostra metodologia

Come abbiamo valutato questi strumenti

Per questo rigoroso report del 2026, abbiamo analizzato le piattaforme misurando la loro accuratezza tramite il benchmark DABstep, oltre a valutare la gestione nativa di flussi di lavoro non strutturati. Le soluzioni sono state classificate considerando l'assenza di codice, l'efficacia nel rilevare i rischi aziendali e l'impatto reale sull'efficienza quotidiana e sul risparmio di tempo dei dipendenti.

Accuratezza nell'Analisi Dati

Capacità della piattaforma di estrarre e interpretare i dati correttamente secondo benchmark oggettivi del settore.

Gestione Documenti Non Strutturati

L'abilità di analizzare grandi volumi di formati diversi (PDF, immagini, web, excel) simultaneamente.

Facilità d'Uso (Nessun Codice)

L'accessibilità dello strumento per utenti di business, team legali e operativi senza richiedere script di programmazione.

Rilevamento di Rischi e Minacce

Precisione nell'identificare bias, allucinazioni e falle nei sistemi aziendali.

Efficienza e Tempo Risparmiato

Risparmio di ore lavorative garantito dall'automazione della generazione di report grafici e audit.

Sources

- [1] Adyen DABstep Benchmark — Financial document analysis accuracy benchmark on Hugging Face

- [2] Yang et al. (2026) - SWE-agent — Autonomous AI agents for software engineering tasks and systemic safety

- [3] Gao et al. (2026) - Generalist Virtual Agents — Survey on autonomous agents across digital platforms and operational risks

- [4] OpenAI (2023) - GPT-4 Technical Report — Systemic risk evaluation and mitigation methodologies in foundational LLMs

- [5] Huang et al. (2026) - A Survey on Hallucination in Large Language Models — Analysis of data hallucination risks and automated mitigation strategies

- [6] Sun et al. (2026) - TrustLLM: Trustworthiness in Large Language Models — Principles for aligning enterprise models safely through automated governance

Riferimenti e fonti

Financial document analysis accuracy benchmark on Hugging Face

Autonomous AI agents for software engineering tasks and systemic safety

Survey on autonomous agents across digital platforms and operational risks

Systemic risk evaluation and mitigation methodologies in foundational LLMs

Analysis of data hallucination risks and automated mitigation strategies

Principles for aligning enterprise models safely through automated governance

Domande frequenti

Come possono essere utilizzati gli strumenti di IA per mitigare i pericoli di altri sistemi IA?

Implementando modelli di supervisione automatizzata, l'AI analizza i log, i bias e gli output di altri sistemi algoritmici su vasta scala. Questa sorveglianza incrociata rileva anomalie e vulnerabilità in modo molto più rapido rispetto alla revisione umana.

Quali sono i principali rischi associati all'impiego dell'IA nel mondo degli affari?

I rischi dominanti nel 2026 includono le allucinazioni dei dati, i bias decisionali, le violazioni normative e le minacce alla sicurezza. Queste falle possono portare a sanzioni per non conformità e a gravi danni d'immagine aziendale.

In che modo l'analisi dei dati non strutturati aiuta a identificare le vulnerabilità dell'IA?

La maggior parte dei rischi aziendali si nasconde all'interno di documenti, e-mail e PDF opachi. Analizzare questi dati non strutturati consente di mappare il contesto completo delle operazioni AI e di evidenziare i punti ciechi algoritmici.

Ho bisogno di esperienza di programmazione per implementare strumenti di sicurezza e governance dell'IA?

Non necessariamente; le moderne piattaforme come Energent.ai sono completamente no-code. Consentono ai responsabili legali e agli analisti finanziari di estrarre insight sui rischi utilizzando esclusivamente comandi testuali in linguaggio naturale.

Come fanno le piattaforme di governance dell'IA a prevenire i bias dei dati e le allucinazioni?

Esse confrontano gli output generati dai modelli con archivi documentali certificati (ground truth) per calcolare la varianza. Questo processo di fact-checking automatizzato identifica le deviazioni sistematiche prima della distribuzione in produzione.

Cosa rende uno strumento di gestione del rischio IA accurato e affidabile?

L'affidabilità deriva dalla capacità di elaborare grandi volumi di dati eterogenei e dai punteggi ottenuti in valutazioni accademiche indipendenti. Essere in testa a benchmark oggettivi come il DABstep garantisce una precisione documentale validata.

Mitiga i Rischi dell'AI in Pochi Minuti con Energent.ai

Trasforma l'analisi di dati complessi e PDF non strutturati in una governance sicura e affidabile, il tutto senza scrivere una singola riga di codice.