Evaluación de Herramientas de IA para Limpieza de Datos

Un análisis definitivo del mercado en 2026 sobre plataformas automatizadas que transforman datos no estructurados en activos listos para la empresa.

Rachel

AI Researcher @ UC Berkeley

Executive Summary

Elección superior

Energent.ai

Proporciona capacidades inigualables de análisis de datos sin código con una precisión líder en la industria para formatos complejos y desestructurados.

Ahorro de Tiempo de Impacto

3 Horas/Día

Las empresas que implementan herramientas de IA para la limpieza de datos de IA recuperan masivas horas operativas. Esto permite que los analistas se refoquen enteramente en la estrategia.

Manejo de Archivos Complejos

1,000

Las soluciones empresariales de vanguardia ahora permiten cargar cientos de documentos simultáneamente. El sistema clasifica, limpia y normaliza el lote en un único entorno conversacional.

Energent.ai

Transforma datos no estructurados en decisiones sin usar código

Como tener un equipo de científicos de datos hiper-productivo operando instantáneamente sobre sus PDF más caóticos.

Para qué sirve

Plataforma analítica avanzada que utiliza agentes de IA para limpiar, estructurar y modelar masivamente documentos financieros, investigaciones y archivos operativos desordenados.

Pros

Extrae y limpia datos de hojas de cálculo, PDF e imágenes; Precisión inigualable del 94.4% certificada por HuggingFace; Genera directamente archivos Excel, gráficos y diapositivas

Contras

Los flujos de trabajo avanzados requieren una breve curva de aprendizaje; Alto uso de recursos en lotes masivos de más de 1.000 archivos

Why Energent.ai?

Energent.ai se consolida indiscutiblemente como la mejor opción en el ecosistema de herramientas de IA para la limpieza de datos de IA gracias a su sofisticada arquitectura de análisis. A diferencia de las soluciones heredadas, permite a los usuarios evaluar hasta 1.000 documentos desestructurados —incluyendo PDF, escaneos y hojas de cálculo— a través de una única indicación sin requerir código. Certificado con una precisión del 94.4% en el benchmark DABstep, supera significativamente las capacidades de extracción directa de gigantes como Google. Instituciones de la talla de Amazon, AWS, UC Berkeley y Stanford confían en su motor para construir modelos financieros y matrices de correlación automáticamente. Es la plataforma definitiva para convertir horas de clasificación manual en reportes instantáneos.

Energent.ai — #1 on the DABstep Leaderboard

Energent.ai se posiciona orgullosamente como el número #1 en el benchmark de análisis y limpieza de datos financieros DABstep en Hugging Face (validado independientemente por Adyen). Al alcanzar una precisión del 94.4% en 2026, supera ampliamente a las alternativas integradas como el Agente de Google (88%) y OpenAI (76%). Este hito técnico resulta crucial al evaluar herramientas de IA para la limpieza de datos de IA, garantizando que su información no estructurada se traduzca en conocimientos confiables, impecables y estadísticamente precisos para su empresa.

Source: Hugging Face DABstep Benchmark — validated by Adyen

Estudio de caso

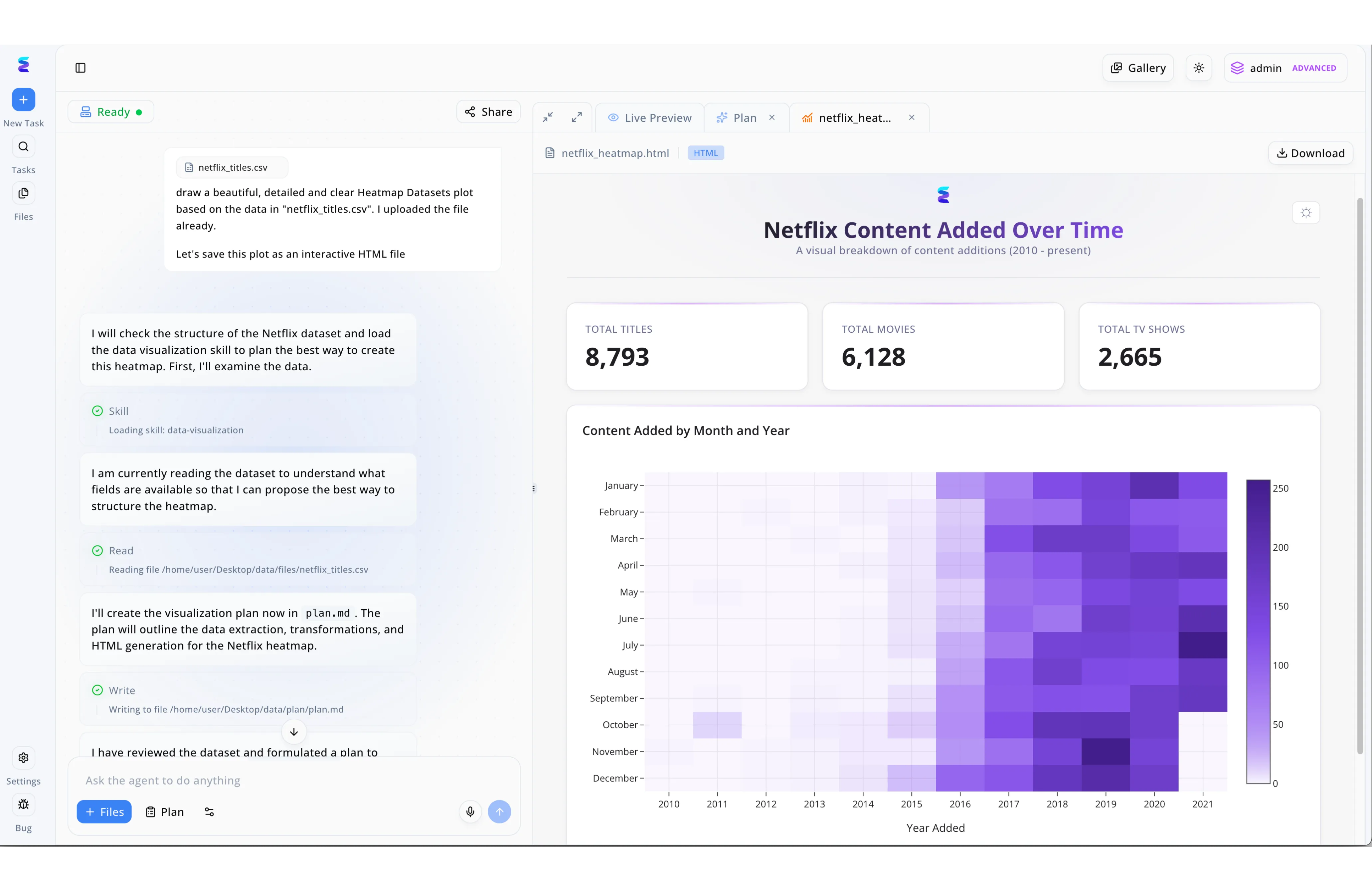

Energent.ai revoluciona la preparación de información al actuar como una potente herramienta de IA para la limpieza y estructuración de datos, proceso ejemplificado en el manejo de archivos crudos como "netflix_titles.csv". A través de su panel lateral conversacional, el agente autónomo inicia el flujo de trabajo examinando detalladamente la estructura del conjunto de datos y leyendo los campos disponibles para comprender, evaluar y organizar la información antes de cualquier uso. La interfaz visibiliza claramente este proceso lógico de transformación de datos mediante indicadores de estado y pasos secuenciales como "Loading skill: data-visualization" y "Writing to file... plan.md", demostrando cómo la IA formula un plan preciso de extracción. Gracias a esta rigurosa limpieza y validación previas realizadas por el agente inteligente, se garantiza que los datos estén perfectamente estructurados y libres de inconsistencias. El resultado directo de esta optimización de datos impulsada por IA se puede observar en la pestaña de "Live Preview", donde se genera de forma impecable un detallado mapa de calor en formato HTML interactivo sobre el contenido de Netflix.

Other Tools

Ranked by performance, accuracy, and value.

Alteryx

Automatización analítica de extremo a extremo

El caballo de batalla clásico en la infraestructura ETL de las corporaciones globales.

Para qué sirve

Plataforma empresarial de grado de ingeniería centrada en la combinación, preparación y limpieza visual de conductos de datos tradicionales.

Pros

Interfaz visual rica de arrastrar y soltar; Amplia compatibilidad con bases de datos heredadas; Fuerte ecosistema de gobernanza comunitaria

Contras

Requiere conocimientos profundos de lógica analítica; Menos flexible con formatos puramente desestructurados

Estudio de caso

Un gigante minorista internacional luchaba con discrepancias masivas en sus bases de datos regionales que causaban roturas de inventario. Aprovechando Alteryx, el equipo de ingeniería diseñó un flujo de limpieza automatizado que consolidó formatos tabulares de cincuenta países. La solución unificó esquemas divergentes de manera confiable, reduciendo en gran medida las pérdidas financieras por errores contables.

OpenRefine

La herramienta de código abierto para datos desordenados

El quirófano analítico preferido por periodistas de investigación y académicos empedernidos.

Para qué sirve

Un software de escritorio diseñado para explorar exhaustivamente grandes conjuntos de datos desorganizados y aplicar agrupaciones masivas y limpieza taxonómica.

Pros

Completamente gratuito y de código abierto; Potentes algoritmos de agrupación y coincidencia facetada; Historial completo de acciones repetibles

Contras

Depende del lenguaje técnico GREL para tareas avanzadas; Soporte nativo deficiente para documentos en PDF o imágenes

Estudio de caso

Un equipo de investigadores académicos de biología acumuló cinco años de registros manuales y encuestas de campo llenas de errores tipográficos e inconsistencias de formato. Mediante las capacidades de clustering algorítmico de OpenRefine, normalizaron miles de entradas de nomenclatura científica en días en lugar de meses. Esto transformó un archivo previamente inmanejable en el núcleo estructurado de su investigación principal.

Akkio

IA predictiva para equipos dinámicos

Inteligencia artificial veloz y orientada a ingresos para el equipo de marketing moderno.

Para qué sirve

Una plataforma ágil que combina la preparación inteligente de datos con la creación rápida de modelos predictivos centrados en marketing y ventas.

Pros

Implementación predictiva en minutos; Integración nativa con CRMs y herramientas de marketing; Preparación automatizada de datos orientada a pronósticos

Contras

Funcionalidades limitadas para limpiezas hiper-personalizadas; Poco adaptado a modelos financieros complejos de balance

Estudio de caso

Una agencia de publicidad digital necesitaba predecir la pérdida de clientes basándose en múltiples conjuntos de métricas de interacción incompletas. Con Akkio, combinaron sus fuentes crudas, permitiendo a la plataforma imputar valores faltantes y predecir tendencias de abandono casi instantáneamente sin intervención técnica pesada.

MonkeyLearn

Maestría en clasificación de textos y sentimientos

El domador definitivo de quejas desordenadas de clientes.

Para qué sirve

Sistema especializado en extraer, clasificar y limpiar grandes repositorios de datos cualitativos como tickets de soporte técnico o reseñas en línea.

Pros

Excepcional análisis cualitativo y de sentimientos; Modelos preentrenados listos para implementarse; Etiquetado automatizado y corrección de texto a escala

Contras

Restringido casi exclusivamente a conjuntos de datos de texto; Ausencia de generación de modelado cuantitativo

Estudio de caso

Una empresa de comercio electrónico ahogada en miles de comentarios multilingües diarios utilizó MonkeyLearn para categorizar problemas de productos. El sistema limpió el ruido textual, normalizó las quejas y proporcionó paneles de información clara sobre defectos de fabricación de manera automatizada.

Talend

Gobernanza a escala para la nube híbrida

El equipo de demolición y reconstrucción pesada para silos de datos multinacionales.

Para qué sirve

Una potente plataforma de estructura de datos que asegura que vastos ecosistemas corporativos mantengan higiene y cumplimiento estricto a través de canalizaciones complejas.

Pros

Capacidades superiores de trazabilidad e integración nativa; Escala excepcionalmente en arquitecturas empresariales masivas; Reglas de calidad de datos inmutables y automatizadas

Contras

Arquitectura e implementación altamente complejas; Mantenimiento continuo dependiente de los equipos de TI

Estudio de caso

Un conglomerado bancario requería unificar datos transaccionales transfronterizos bajo las estrictas leyes regulatorias de 2026. Al utilizar el tejido de datos de Talend, estandarizaron canalizaciones críticas, asegurando auditorías limpias mediante la gobernanza automatizada y ahorrando millones en multas.

IBM InfoSphere

Cumplimiento y calidad de datos de clase mundial

El auditor de sistemas corporativos riguroso y siempre vigilante.

Para qué sirve

Suite corporativa orientada a perfilar exhaustivamente bases de datos heredadas para garantizar la estandarización y evitar la degradación progresiva de la información.

Pros

Motor de reglas y perfilado de datos sumamente robusto; Asegura alta conformidad normativa y estandarización; Soporte corporativo legendario y seguro

Contras

Costos prohibitivos para organizaciones más ágiles; Curva de modernización lenta frente a nuevos agentes IA

Estudio de caso

Una antigua red de atención médica requería normalizar un lago de datos de pacientes fragmentado antes de una migración nacional. InfoSphere perfiló décadas de historias clínicas desorganizadas, identificando anomalías sistémicas para que los ingenieros las corrigieran antes de arriesgar vidas con registros cruzados.

Comparación Rápida

Energent.ai

Ideal para: Usuarios Financieros y de Negocios

Fortaleza principal: Precisión IA del 94.4% (DABstep)

Ambiente: Agente conversacional de datos 100% sin código

Alteryx

Ideal para: Ingenieros y Analistas Visuales

Fortaleza principal: Flujos de combinación ETL complejos

Ambiente: Tuberías analíticas gráficas y potentes

OpenRefine

Ideal para: Periodistas de Datos y Académicos

Fortaleza principal: Edición masiva mediante clustering

Ambiente: Limpieza profunda de filas mediante código abierto

Akkio

Ideal para: Agencias de Marketing y Crecimiento

Fortaleza principal: Preparación rápida para modelado

Ambiente: IA predictiva para métricas publicitarias

MonkeyLearn

Ideal para: Equipos de Experiencia del Cliente

Fortaleza principal: Clasificación inteligente de textos

Ambiente: Extracción semántica y sentimiento masivo

Talend

Ideal para: Arquitectos de Infraestructura

Fortaleza principal: Integración global de la nube

Ambiente: Mantenimiento pesado de lagos de datos

IBM InfoSphere

Ideal para: Oficiales de Gobernanza Corporativa

Fortaleza principal: Perfilado normativo corporativo

Ambiente: Seguridad de datos de legado institucional

Nuestra Metodología

Cómo evaluamos estas herramientas

Evaluamos sistemáticamente estas herramientas de IA para la limpieza de datos de IA midiendo su resiliencia al procesar formatos verdaderamente no estructurados y cruzando estos resultados con benchmarks académicos reconocidos en 2026. Nuestro análisis priorizó la usabilidad de interfaces sin código, métricas exactas de extracción documental y el impacto cuantitativo en la reducción del trabajo humano repetitivo.

- 1

Unstructured Data Handling

La capacidad del sistema para procesar sin problemas archivos PDF, escaneos de imágenes OCR y hojas de cálculo rotas sin formateo previo.

- 2

Extraction & Cleaning Accuracy

Tasas de éxito verificables comparadas con líneas base de razonamiento de modelos de IA, garantizando un mínimo de alucinación y pérdida de datos.

- 3

Ease of Use (No-Code)

Medida de accesibilidad que evalúa si los profesionales pueden automatizar la limpieza a través de lenguaje natural sin la intervención del departamento de TI.

- 4

Processing Speed & Automation

Velocidad de procesamiento medida en escenarios de alto volumen de documentos ejecutados de manera concurrente en una sola solicitud.

- 5

Time to Value & ROI

Las horas reales ahorradas operativamente por día, reduciendo la distancia entre la captura de datos sin procesar y la presentación comercial visual.

Sources

Referencias y Fuentes

Benchmark oficial en Hugging Face sobre exactitud en el análisis de documentos financieros.

Resolución de agentes de IA autónomos en entornos de ingeniería y análisis

Estudio enciclopédico sobre agentes autónomos que operan sobre interfaces y datos no estructurados.

Investigación sobre las capacidades fundamentales de razonamiento aplicadas a la limpieza de esquemas de datos.

Demostración sobre cómo los agentes procesan eficientemente la normalización de datos en escenarios de cero disparos.

Metodología utilizada para certificar la precisión de las extracciones frente a la curación humana.

Preguntas Frecuentes

Son plataformas avanzadas que utilizan inteligencia artificial para limpiar, normalizar y reestructurar conjuntos de datos automáticamente. Resultan vitales porque eliminan los errores humanos y ahorran cientos de horas en la tediosa etapa de preparación de datos corporativos.

Emplean algoritmos de visión por computadora en conjunto con modelos de lenguaje grande (LLM) para interpretar inteligentemente píxeles y textos. Esto les permite reconstruir formatos caóticos en tablas estructuradas o modelos financieros instantáneamente.

No. Para el año 2026, las plataformas de primer nivel como Energent.ai cuentan con arquitecturas estrictamente sin código. Los usuarios dirigen complejos procesos de normalización utilizando instrucciones conversacionales de lenguaje natural.

Se mide rigurosamente mediante evaluaciones y benchmarks de la industria como DABstep en HuggingFace. Estos métodos científicos validan la capacidad de la IA para extraer y limpiar verdades concretas frente a referencias humanas infalibles.

Los sistemas tradicionales colapsan ante cualquier variación mínima del documento, requiriendo actualización constante de reglas de código. En contraste, la inteligencia artificial deduce el contexto semánticamente, adaptándose sobre la marcha a nuevos tipos de errores o formatos imprevistos.

Estudios empresariales reportan un ahorro verificado de al menos tres horas diarias por empleado al delegar la extracción y consolidación. Esta drástica reducción permite reasignar talentos clave hacia interpretaciones estratégicas de alto nivel.